Servicios Personalizados

Revista

Articulo

Indicadores

-

Citado por SciELO

Citado por SciELO -

Accesos

Accesos

Links relacionados

-

Citado por Google

Citado por Google -

Similares en

SciELO

Similares en

SciELO -

Similares en Google

Similares en Google

Compartir

Revista de Economía Institucional

versión impresa ISSN 0124-5996

Rev.econ.inst. v.12 n.22 Bogotá ene./jun. 2010

LA CRISIS ACTUAL Y LA CULPABILIDAD DE LA TEORÍA MACROECONÓMICA

THE CURRENT CRISIS AND THE CULPABILITY OF MACROECONOMIC THEORY

Paul Ormerod*

* Magíster en Economía, director de Volterra Consulting, Londres, Inglaterra, [pormerod@volterra.co.uk; www.paulormerod.com]. Versión ampliada de un escrito que se presentó en la Reunión General Anual de la Academia Británica de Ciencias Sociales, Londres, julio de 2009. Agradezco a Bridget Rosewell, Geoff Hodgson, Brian Loasby, Bob Rowthorn y a los miembros de la Academia de Ciencias Sociales y de la Accumulation Society por sus útiles comentarios. Volterra Consulting, 135c Sheen Lane, London SW14 8AE, UK. En inglés se publicó en 21st Century Society: Journal of the Academy of Social Sciences 5, 1, 2010. Traducción de Alberto Supelano.

RESUMEN

[Palabras clave: agentes racionales, expectativas racionales, riesgo, incertidumbre; JEL: E20, E32, E60]

Las ideas de la macroeconomía moderna proporcionaron la justificación intelectual de las políticas económicas de los últimos diez o quince años. La crisis actual ha puesto en cuestión estas ideas. El paradigma dominante en la teoría macroeconómica de los últimos treinta años ha sido el de los agentes racionales que forman racionalmente sus expectativas acerca del futuro y toman decisiones óptimas. El objetivo es estudiar la forma en que estos agentes se ocupan del riesgo y la incertidumbre, origen de los problemas de la disciplina económica, de la economía y de la crisis financiera. La macroeconomía moderna tiene responsabilidad en la crisis financiera, pues impone su base intelectual a un mundo en que opera en situaciones de riesgo que se subestiman de manera sistemática y lleva a que las situaciones de auténtica incertidumbre no sean reconocidas claramente.

ABSTRACT

[Keywords: rational agents, rational expectations, risk, uncertainty; JEL: E20, E32, E60]

The ideas of modern macroeconomics provided the intellectual justification of the economic policies of the last 10 to 15 years. It is these ideas which the financial crisis falsified. The dominant paradigm in macroeconomic theory over the past 30 years has been that of rational agents who form rational expectations about the future and make optimal decisions. The aim of the paper is to study how these agents deal with risk and uncertainty, the source of the problems of the discipline of economics, the economy and the financial crisis. Modern macroeconomics has responsibility for the financial crisis, because imposes its intellectual foundation to a world that operates in situations involving risk that are systematically underestimated and leads to not recognized situations of genuine uncertainty.

Una de las afirmaciones más conocidas de Keynes se refiere al poder de las ideas. En su obra magna de 1936, La teoría general, dijo: los hombres prácticos, que se creen exentos de cualquier influencia intelectual, suelen ser esclavos de algún economista difunto. Locos con autoridad, que oyen voces en el aire, extraen sus locuras de algún escritorzuelo académico de años atrás.

Mucho se ha escrito sobre el papel de los hombres prácticos en la actual crisis financiera, bien sean banqueros, reguladores o políticos. Aquí me centro en el papel de la ideas y específicamente de las ideas en teoría económica.

Las ideas que integran el núcleo de la macroeconomía moderna proporcionaron la justificación intelectual de las políticas económicas de los últimos diez o quince años. La crisis actual ha puesto en cuestión estas ideas. El paradigma dominante en teoría macroeconómica durante los treinta años anteriores ha sido el de los agentes racionales que toman decisiones óptimas con el supuesto de que forman racionalmente sus expectativas acerca del futuro, es decir, el agente racional que tiene expectativas racionales o, para abreviar, el agente RARO1.

Éste no es el lugar para hacer una crítica detallada de la visión del mundo RARA. El tema específico es la forma en que la economía predominante trata el riesgo y la incertidumbre. La cual es el origen de los problemas de la disciplina económica y, aún más importante, de la economía y de la crisis financiera.

RIESGO E INCERTIDUMBRE: ANTECEDENTES HISTÓRICOS

Algunos de los autores más conocidos en el pensamiento económico hicieron una importante distinción entre el riesgo y la incertidumbre. La persona que formalizó esta distinción fue Frank Knight en Chicago, cuyo libro clave sobre el tema fue publicado en 1921. Knight es mucho menos conocido que otros dos autores que voy a mencionar, pero de tal estatura que Milton Friedman lo describió como uno de los científicos sociales más originales e influyentes del siglo XX.

Knight argumentó en esencia que el concepto de riesgo se aplica en circunstancias en las que conocemos o al menos tenemos una buena idea de la distribución de probabilidad de los posibles resultados. Pero cuando nuestro conocimiento de esta distribución es impreciso o inexistente, la incertidumbre es el concepto relevante. Así, por ejemplo, apostar dinero a la ruleta es riesgoso. Conocemos la probabilidad exacta de cada uno de los resultados a los que podemos apostar. Hay incertidumbre si apostamos pero no sólo no sabemos cuántos números hay en la ruleta sino que tampoco sabemos si la esfera pasa por todos ellos. La característica esencial de la verdadera incertidumbre es que es incalculable, por muy inteligentes que seamos. Las situaciones prácticas pueden estar más cerca de la incertidumbre que del riesgo porque, por ejemplo, podemos tener una muestra de acontecimientos demasiado pequeña para estimar la probabilidad o, más en general, porque tenemos un conocimiento inadecuado de los mecanismos causales involucrados en una situación dada.

Keynes creía que la incertidumbre era más importante que el riesgo, y que esa era la razón clave del ciclo económico, de los ascensos y descensos del capitalismo. En la Teoría general escribió:

El hecho sobresaliente es la extrema precariedad de la base de conocimientos con la que debemos hacer nuestras estimaciones del rendimiento potencial [de una nueva inversión]. Si hablamos con franqueza, debemos admitir que nuestra base de conocimientos para estimar el rendimiento de aquí a diez años de un ferrocarril, una mina de cobre, una fábrica textil, la patente de un medicamento, un trasatlántico o un edificio en la City de Londres es muy pequeña y a veces nula, e incluso de aquí a cinco años.

Con base en un cálculo puramente racional se harían muy pocas inversiones y se crearían muy pocas firmas nuevas puesto que muchas de esas aventuras fracasan. Es el optimismo irracional del inversionista, del empresario, lo que hace posible que sucedan, la creencia de que se tiene una idea o un concepto mejor que está destinado a tener éxito.

Hayek fue aún más allá y pensó que hay límites inherentes al conocimiento que no puede superar el mayor intelecto. Su discurso Nobel de 1974 lleva por título La pretensión del conocimiento. Conforme a este punto de vista, la economía está signada por una incertidumbre inherente e inevitable. En este sentido, Hayek fue un precursor intelectual de la teoría de sistemas complejos.

Aunque ha sido culpado por asociación debido a que su obra ha sido citada con aprobación por los teóricos de las expectativas racionales, su análisis del ciclo económico es de muchas maneras similar al de Keynes, aunque diferían en asuntos de política. Es cierto que Hayek pensaba que el equilibrio general debía ser el fundamento de la teoría del ciclo económico. Pero la teoría se debía ampliar considerablemente para que pudiera explicar las fluctuaciones persistentes del producto agregado. Las firmas y los gobiernos actúan en un ambiente tan complejo que no sólo sus expectativas a menudo resultan erróneas sino que son incapaces de aprender lo suficiente del pasado para evitar el mismo error en el futuro. El nivel de incertidumbre es tan alto que aun el banco central no puede aprender a contrarrestar las expectativas mediante cambios en la política monetaria para suavizar el ciclo y restablecer el equilibrio.

La teoría macroeconómica moderna falló en su apreciación del riesgo y de la incertidumbre.

AGENTES RACIONALES Y EXPECTATIVAS RACIONALES

El hecho de que la economía se haya apropiado del término racional para describir el comportamiento de los agentes –individuos, firmas y gobiernos– en su visión de cómo funciona el mundo es un golpe propagandístico. Después de todo, ¿quién querría ser considerado irracional o incluso tener la temeridad de sugerir modelos donde los agentes se comportan irracionalmente?

Sin embargo, como ya se señaló, algunos de los más grandes pensadores de la economía, como Keynes y Hayek, no suscribieron la visión RARA del mundo. Pero tales herejías fueron purgadas por mucho tiempo del canon, y es raro –en el sentido normal del término– conocer a un joven economista que haya leído alguna de las obras de estos dos economistas en el original. También se debería añadir que prácticamente toda la disciplina de la psicología, para no hablar de la antropología y la sociología, indica que el comportamiento que se acerca a los supuestos RAROS es a lo sumo un caso especial muy limitado del comportamiento real de los seres humanos.

Las expectativas racionales no requieren que las predicciones del agente acerca del futuro sean siempre correctas. De hecho, pueden resultar incorrectas en cada período y seguir siendo racionales. El requisito es que las expectativas sean correctas en promedio durante un largo período. Se supone que los agentes toman en cuenta toda la información relevante y que hacen predicciones que en promedio son insesgadas. Las desviaciones con respecto a la previsión perfecta en un período dado son una característica inherente a este postulado de comportamiento, pero deben ser aleatorias. Si las desviaciones tuvieran un patrón sistemático se supondría que el agente incorpora ese patrón en sus expectativas. Y de nuevo, durante un largo período, tales expectativas son correctas en promedio.

Para alguien que crea realmente en su validez es difícil falsear la teoría. Aun el fracaso más dramático para predecir el futuro, como el de la crisis financiera de 2008, se puede justificar como un error aleatorio. Un entusiasta de las expectativas racionales puede seguir defendiendo la corrección de la teoría suponiendo simplemente que las expectativas de los agentes resultan ser precisas en promedio durante algún período de tiempo (teóricamente indeterminado).

Uno de los supuestos de la teoría es que, como parte del conjunto de información que procesa, el agente posee el modelo correcto de la economía. De hecho, según la lógica de la teoría, si el modelo que se usa para hacer predicciones no fuera correcto, las predicciones exhibirían algún tipo de sesgo, un error sistemático, y los agentes advertirían que estaban equivocados.

Es razonable argumentar que es difícil aceptar la opinión de que los agentes entienden el modelo correcto de la economía puesto que los mismos economistas difieren en su visión de cómo funciona la economía. Por ejemplo, en el otoño de 2008, muchos economistas estadounidenses famosos, incluidos algunos ganadores del Premio Nobel, se opusieron enérgicamente a toda forma de salvamento del sistema financiero argumentando que era mejor dejar que los bancos quebraran. Otros, incluidos quienes toman las decisiones en la Reserva Federal y en la Tesorería, adoptaron una visión totalmente diferente.

No obstante, la corriente académica predominante insiste en que dentro de la profesión existe una fuerte tendencia a la convergencia de las opiniones acerca de la teoría macroeconómica, un tema que se trata más adelante. Por implicación, quien adopte una visión diferente y no sea parte de esta convergencia intelectual no es un economista idóneo.

Pero, primero que todo, vale la pena discutir un ejemplo de la vida real de un modelo que usan ampliamente en finanzas los practicantes y diseñadores de política, el cual no sólo ha mostrado ser erróneo sino que durante bastante tiempo se ha sabido que era erróneo. Específicamente, erróneo en la forma de medir el riesgo. Y esta evaluación incorrecta del riesgo jugó un papel importante en la crisis financiera. Así, en clara y total contradicción con el supuesto RARO de que los agentes conocen el modelo verdadero de la economía, se usó un mal modelo en un sector absolutamente crítico de la economía.

LA FIJACIÓN DEL PRECIO DEL RIESGO: EL PROBLEMA DE LA COLA GRUESA

El valor en riesgo (VAR) de un portafolio de activos financieros es una medida de la pérdida potencial sobre el portafolio en un horizonte de tiempo determinado. Desde la década de 1990 es de uso común en las instituciones financieras y en las entidades reguladoras. El cálculo típico del VAR estima la cantidad de dinero que estará en riesgo el día siguiente con una probabilidad del 1% o del 5%. Es un concepto muy seductor. Unos minutos después del cierre de la rueda de Londres o de Nueva York, la junta de una compañía puede recibir un número que pretende representar la cantidad de dinero que estará en riesgo en el portafolio de la compañía el día siguiente con una probabilidad determinada.

Los cálculos constan en esencia de dos pasos. El primero es el núcleo del enfoque. Para un activo individual, se calcula la probabilidad de que el precio del día siguiente (o de cualquier otro período elegido) cambie con respecto al precio actual en cantidades especificadas.

El segundo paso permite correlaciones cruzadas entre los activos individuales. Un conjunto de activos puede tener riesgos menores que un activo individual. Los precios de las acciones y los bonos, por ejemplo, tienden a moverse en direcciones opuestas. Harry Markowitz recibió el Premio Nobel de economía en 1990 por su trabajo en esta área, el análisis media-varianza, que es una parte clave de la teoría moderna del portafolio. No obstante, la validez científica del método usual para calcular las correlaciones cruzadas tiene graves problemas (ver, p. ej., Laloux et al., 1999, y Plerou et al., 1999). Pero aquí el punto es la manera de calcular la probabilidad de cambio del precio de un activo individual en la mayoría de los sistemas VAR.

Este proceso parece ser un cálculo correcto del riesgo. Hay una enorme cantidad de datos para calibrar la distribución de probabilidad de los cambios del precio de la mayoría de los activos. Parece entonces ser el mismo tipo de problema que el de encontrar la probabilidad de sacar un par de seises (o de cincos o cualquier otro) en un lanzamiento de dados.

En la práctica, se solía suponer que los cambios de precio siguen la distribución normal o distribución de Gauss. En su mayor parte la siguen. Cuando examinamos la evidencia y observamos los cambios del precio actual, parecen seguir este patrón bien conocido. Pero hay una diferencia sutil y profunda. La posibilidad de ver a un hombre de una pulgada o de veinte pies de alto es literalmente casi igual a cero, porque la estatura humana (de cada género) se aproxima bastante, a lo largo de toda la distribución, a la distribución normal. Pero la posibilidad de ver el precio de una acción equivalente a esas estaturas no es igual a cero. Las oportunidades no son altas, pero ocurren en la realidad.

En la jerga estadística, este tipo de patrón se conoce como colas gruesas. Cuanto más nos alejamos del promedio, más nos acercamos a las colas; en otras palabras, a los segmentos de la distribución donde el número de veces que vemos tales valores es muy bajo. El grueso de los cambios de precios que observamos se encuentra en el cuerpo de la distribución, por decirlo así, y sólo algunos ejemplos en las colas, que están poco pobladas. Con la distribución normal, estos se desvanecen muy rápidamente, de modo que la cola desaparece en la práctica una vez nos alejamos una distancia razonable del promedio. Si la cola es gruesa, esto no significa que veamos muchos ejemplos de cambios realmente grandes. Pero vemos más de los que veríamos si el patrón de cambios siguiera realmente la distribución normal.

Esto puede parecer esotérico. Pero está en el centro de la crisis financiera. Todo parecía ir muy bien, y el dinero circulaba en abundancia. Hasta que un día apareció un hombre de 20 pies de alto. Un precio subyacente cambia en una cantidad que es excluida por el supuesto de normalidad. Casi todos los sistemas de valor en riesgo perdieron su valor, como de hecho lo perdieron algunas compañías cuando apareció el hombre de 20 pies.

El fenómeno de las colas gruesas en los cambios de precios se conoce desde 1900, cuando Louis Bachelier presentó su tesis doctoral en París. Es cierto que su trabajo languideció en la oscuridad durante varias décadas, pero en el último cuarto del siglo XX, la evidencia del fenómeno de la cola gruesa apareció a raudales. Los descubrimientos iniciales fueron obra de otro matemático francés, que pasó gran parte de su vida en Estados Unidos, Benoit Mandelbrot (Mandelbrot, 1963). En la década de 1990, el torrente se convirtió en inundación cuando algunos de los físicos estadísticos más distinguidos del mundo empezaron a interesarse en los mercados financieros. Gene Stanley en Boston, editor de la revista de reputación mundial Physica A, Rosario Mantegna en Palermo, Jean Philippe Bouchaud en París, Yi-Cheng Zhang en Friburgo y una multitud de colegas y estudiantes de posgrado suyos examinaron los datos de los cambios de precios en los mercados financieros. Y encontraron colas gruesas en todas partes. Lejos de ser inusuales, de ser la excepción, las colas gruesas eran la norma. Un gran número de escritos académicos de alta calidad se podía consultar en Internet, y cada uno de ellos demostraba la existencia de colas gruesas en algún aspecto particular de los mercados financieros.

A pesar de esta evidencia científica abrumadora, las colas gruesas fueron ignoradas en los mercados financieros. El resultado fue que se subestimó sistemáticamente el potencial de volatilidad, en particular el potencial de grandes cambios en los precios de los activos financieros. De modo que tenemos un modelo, utilizado por las instituciones financieras más grandes del mundo y por los reguladores, que no sólo era erróneo sino que se sabía que era erróneo. Pero aun así, un verdadero creyente en lo RARO podía estar tentado a argumentar que ésta no era una refutación de la teoría, sino evidencia en su favor, ¡porque los agentes ahora sabían que el supuesto gaussiano de la distribución de los cambios de precios de los activos es erróneo!

CONVERGENCIA Y COMPLACENCIA EN MACROECONOMÍA

Los retos intelectuales que plantea el modelo nuclear de la economía convencional dominaron el tema durante un siglo, desde 1870 hasta comienzos de la década de 1970: el modelo de equilibrio general. Denominado general porque pretende describir cómo surge el equilibrio –cómo se igualan la oferta y la demanda– no sólo en uno o dos mercados sino en la economía en su conjunto, en todos los mercados. Aquí no nos preocupan los detalles técnicos, pero el reto intelectual y matemático de este problema era inmenso. No menos de siete de los primeros once ganadores del Premio Nobel de economía lo recibieron por su trabajo sobre el equilibrio general. Finalmente, a comienzos de la década de 1970, el problema fue resuelto en su totalidad.

Digo en su totalidad, pero es importante entender que esta teoría se refería a una economía con una cantidad fija de recursos, bien fueran trabajo, tierra, energía o capital. La teoría hablaba esencialmente de la asignación óptima, la más eficiente, de un conjunto dado de recursos. Pero hacía referencia a una economía estática y no a una economía dinámica y en crecimiento.

El proyecto principal de los últimos treinta años ha sido tratar de usar la teoría del equilibrio y la teoría RARA para explicar las fluctuaciones dinámicas del producto que se observan en las economías de mercado desarrolladas desde la Revolución Industrial2. Puesto que estas fluctuaciones son persistentes en el tiempo y entre países, son un gran reto para una Weltanschauung basada en el concepto de equilibrio.

El primer intento importante fue la teoría del ciclo económico real (TCR), desarrollada en la década de 1980. La TCR ha sido muy influyente en la economía predominante, y sus autores seminales Finn Kydland y Edward Prescott recibieron el Premio Nobel en 2004.

Según esta teoría, los períodos de alto o bajo crecimiento –los ascensos y descensos del lenguaje cotidiano– son iniciados por choques aleatorios sobre la economía. Esta teoría tiene muchos problemas3, el menor de los cuales es identificar cuáles son estos choques, aunque el que más se utiliza en los modelos de la TCR es el de cambios aleatorios en la productividad.

En la teoría del ciclo real, las recesiones surgen debido a la respuesta racional de los individuos a choques adversos de productividad4. En una ilustración adicional del uso orwelliano de las palabras en la economía predominante, real significa que las recesiones son causadas por factores reales como la productividad y el comportamiento racional de los agentes. ¡Real se yuxtapone a nominal, y los factores nominales son cosas tan irrelevantes como el dinero, el crédito y la deuda!

Los agentes maximizan la utilidad a través del tiempo, eligiendo entre consumo y ocio. Deben tomar dos decisiones en cada período. Primera, cuánto tiempo dedican a trabajar y producir un ingreso y cuánto al ocio. Segunda, qué parte del ingreso dedican a la inversión, la cual aumentará los niveles futuros de producción, y cuánto consumen hoy.

Consideremos la primera de ellas para mostrar por qué el enfoque de la TCR no convenció a muchos economistas tradicionales. Una reducción temporal de la productividad alienta a las personas a trabajar menos en el día de hoy que en el futuro, porque ganarán más por hora en el futuro de lo que ganan hoy. De modo que eligen trabajar menos en el presente. Algunas pueden trabajar mucho menos y aparecer como si estuvieran desempleadas, mientras que según la TCR son agentes racionales que maximizan la utilidad esperada a lo largo de su vida. Krugman señaló que esta explicación del mundo sugiere que la Gran Depresión, cuando casi uno de cada cuatro trabajadores estadounidenses estaba desempleado, fue un día de fiesta extendido voluntariamente.

El último intento para explicar las fluctuaciones del ciclo económico mediante la teoría RARA del equilibrio es lo que algunos llaman modelos dinámicos estocásticos de equilibrio general o DSGE, para usar el término nemotécnico que suelen usar para referirse a ellos. A veces pienso que es una lástima que no fueron inventados por alguien de un Centro de Investigación en Frenología Aplicada, para denominarlos con unas siglas más apropiadas.

Estos modelos, igual que la TCR, se basan en los supuestos microeconómicos básicos de la teoría económica ortodoxa: la maximización racional de la utilidad por los consumidores y la maximización racional del valor por las firmas, y que ambas operan conforme al supuesto de que las expectativas acerca del futuro se forman racionalmente. Los lectores interesados pueden encontrar una revisión detallada de los modelos DSGE en Tovar (2009).

En esencia, los modelos DSGE se construyen en el marco de la TCR tratando incorporar algunas características del mundo real. Por ejemplo, en los modelos de la TCR, los precios son muy flexibles y se ajustan rápidamente a las condiciones económicas prevalecientes. De acuerdo con los postulados DSGE, las firmas ejercen algún grado de poder de mercado, de modo que los precios pueden ser más rígidos y tardar algún tiempo para ajustarse a los nuevos niveles de equilibrio luego de un choque sobre el sistema.

Aunque son muy complicados y difíciles de construir, estos modelos llegaron rápidamente a ser muy influyentes en la economía académica. Por ejemplo, la American Economic Association lanzó en enero de 2009 una nueva revista. ¿Su título? Macroeconomía. Resulta que la profesión académica cree que ha logrado un amplio consenso. El primer número incluye un artículo de uno de los principales macroeconomistas académicos del mundo, Michael Woodford, titulado Convergencia en macroeconomía: elementos de la nueva síntesis (Woodford, 2009).

La primera parte de la nueva síntesis y la más importante es que hoy se acepta ampliamente que el análisis macroeconómico debe usar modelos con fundamentos de equilibrio general intertemporal coherentes. Es increíble que el artículo de Woodford fuese publicado en enero de 2009. Supongo que fue escrito en algún momento de 2008, pero Occidente ya estaba en recesión a mediados de ese año.

Olivier Blanchard es el economista jefe del FMI, y he aquí lo que dijo en agosto de 2008 en un documento de trabajo del MIT titulado El estado de la macro: Durante mucho tiempo después de la explosión de la macroeconomía en los años setenta, el campo parecía un campo de batalla. Con el paso del tiempo, sin embargo, debido sobre todo a que los hechos siguen ahí, ha surgido una visión ampliamente compartida de las fluctuaciones y de la metodología [...] El estado de la macro es bueno. ¡El estado de la macro es bueno! ¡En agosto de 2008!

Y continuó: Los modelos DSGE se han vuelto ubicuos. Decenas de equipos de investigadores participan en su construcción. Casi todos los bancos centrales tienen uno, o desean tener uno. Se usan para evaluar las reglas de política, para hacer previsiones condicionales y a veces incluso para hacer previsiones reales. Para ser justos con Blanchard, luego expresó algunas reservas sobre ellos, pero de carácter técnico, y no se opuso a la idea fundamental de equilibrios racionales. Por el contrario, concluyó que la macroeconomía pasa por un período de gran progreso.

De modo que cuando los políticos proclamaron el fin de los ascensos y descensos tenían detrás una autoridad intelectual increíblemente poderosa: los modelos de los principales bancos centrales, los principales economistas académicos ortodoxos y las principales publicaciones económicas. Realmente creían que habían resuelto los problemas macro del mundo occidental.

LO QUE SUCEDIÓ DESPUÉS

A pesar de estos aparentes avances intelectuales, quienes hacen predicciones siguieron cometiendo exactamente los mismos errores que solían cometer cuando empecé a hacer modelos y predicciones macro en el Instituto Nacional alrededor de los años setenta. Las gráficas de evolución futura (fan charts) del Banco de Inglaterra, que pretenden expresar el rango de incertidumbre de una predicción dada, impedían ver con buenos ojos la posibilidad de una recesión en el Reino Unido en algún momento de los cinco años siguientes, hasta que realmente entramos en recesión.

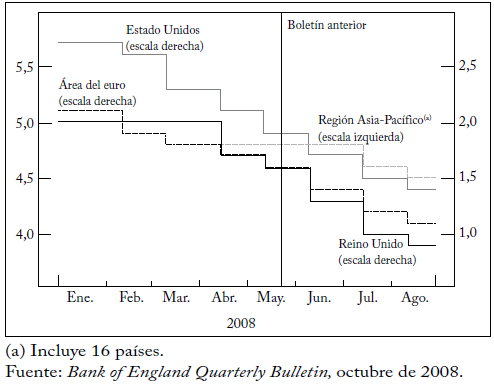

El problema era general. La siguiente es una gráfica de las revisiones que se hicieron a las predicciones de crecimiento del PIB en 2009 a medida que avanzaba el 2008, tomada del Bank of England Quarterly Bulletin .

Gráfica 1

Predicciones del crecimiento del PIB real de 2009 realizadas en 2008

A comienzos de 2008 se preveía un crecimiento decente en 2009. Aun tan tarde como en agosto, la visión general era que habría un crecimiento positivo en 2009. Pero, de hecho, ¡Occidente ya estaba en recesión en agosto de 2008!

Éste no fue un simple error excepcional en una historia de predicción que de otra manera sería ejemplar. La fuerte crisis del Este de Asia de finales de los años noventa fue, por ejemplo, totalmente imprevista. En mayo de ese año el FMI predijo que continuarían las enormes tasas de crecimiento que esas economías habían experimentado durante varios años: proyectó un crecimiento del 7% en Tailandia en 1998, del 7,5% en Indonesia y del 8% en Malasia. En octubre revisó sus predicciones y las redujo al 3,5%, al 6% y al 6,5% respectivamente. Pero en diciembre el FMI preveía apenas un crecimiento del 3% para Malasia e Indonesia, y de cero para Tailandia. Sin embargo, el producto real de estos países en 1998 fue muchísimo peor, pues no creció sino que descendió en gran magnitud. La tasa del PIB real en 1998 fue de un -10% en Tailandia, y de un -7% y un -13% en Malasia e Indonesia respectivamente.

LO QUE SALIÓ MAL: UNA REVISIÓN

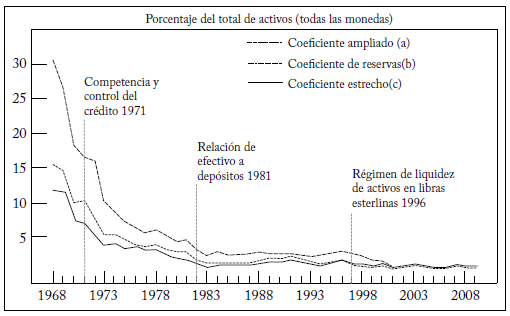

Sobre esto ya se ha escrito en abundancia. Pero intento captar en una sola gráfica la falla de la economía para entender el riesgo y la incertidumbre. Esta fue tomada del Bank of England Quarterly Bulletin de octubre de 2008 y muestra el porcentaje de activos que los bancos del Reino Unido mantenían en forma líquida.

Gráfica 2

Activos líquidos en libras esterlinas/activos totales en posesión del sistema bancario del Reino Unido

(a) Los datos de 2008 son de finales de agosto.

(b) Efectivo + saldos del Banco de Inglaterra + dinero a la vista documentos redescontables + títulos del Reino Unido.

(c) Saldos del Banco de Inglaterra + dinero a la vista documentos redescontables.

(d) Efectivo + saldos del Banco de Inglaterra + documentos redescontables.

Fuente: cálculos del Banco de Inglaterra.

La liquidez, o más bien la falta de liquidez, fue crucial en la crisis financiera. Northern Rock quedó ilíquido desde el comienzo porque no pudo refinanciar sus préstamos. En el peor momento de la crisis los mercados de crédito se congelaron por completo porque los bancos simplemente no sabían si la siguiente institución era solvente o no.

¿Por qué las autoridades permitieron que los bancos redujeran la parte líquida de sus activos hasta un porcentaje tan bajo? Aquí hay algunas preguntas interesantes para los expertos en ciencias políticas y los sociólogos acerca de cómo pudo el capital financiero ejercer tal influencia sobre los gobiernos –y en particular sobre los gobiernos socialdemócratas anglosajones– y convencerlos de que adoptaran esas políticas ridículas. Pero desde la óptica puramente económica pienso que hubo dos razones principales para que se permitieran esas proporciones de activos líquidos increíblemente bajas.

Primera, las autoridades se engañaron a sí mismas pensando que el precio de las enormes cantidades de préstamos y deudas se había fijado racionalmente y, por tanto, de manera óptima. Creían, según el espíritu de la visión RARA del mundo, que los agentes habían usado el modelo correcto para fijar esos precios, aunque como hemos visto no fue así. Si el precio de los préstamos y las deudas se hubiera fijado en forma racional y óptima, la implicación lógica era que los pagos de intereses cubrirían exactamente los riesgos involucrados en los préstamos. De modo que si el individuo o la institución A incumplía un préstamo, se había hecho una provisión suficiente, mediante la fijación óptima del precio del préstamo, para cubrir la pérdida proveniente de tal incumplimiento. No había necesidad de amarrar innecesariamente el capital en activos líquidos cuando se podía prestar con beneficios. Mediante un portafolio de muchos de esos préstamos, el incumplimiento de un solo préstamo no podía causar problemas.

Esto lleva directamente al segundo punto. En el Nuevo Mundo Feliz de los DSGE, la posibilidad de un colapso sistémico, de una cascada de incumplimientos en todo el sistema, no se contemplaba en absoluto. La moderna teoría de la complejidad, y específicamente la teoría de redes, dice que, si pudiéramos repetir la historia muchas veces, en un sistema interconectado el mismo choque inicial puede llevar a resultados totalmente diferentes5. La profesión económica se ha vuelto muy insular y hostil hacia el trabajo científico fuera de su propio campo. Igual que en el caso de las colas gruesas que se discutió más atrás, los economistas en general ignoran la gran cantidad de trabajos sobre cascadas en sistemas interconectados que en las últimas décadas han hecho en numerosas disciplinas los ingenieros de control, los científicos de computación, los físicos y los matemáticos.

La mayoría de las veces, el sistema –bien sea el sistema financiero, la economía en su conjunto o la moda y las tendencias culturales entre los consumidores– contiene los choques la mayoría de las veces y estos no se difunden muy lejos a lo largo del sistema. Pero, en principio, un choque de magnitud idéntica puede disparar una cascada de proporciones globales. Aquí estamos más en el campo de la incertidumbre, de la dificultad para juzgar incluso la distribución de probabilidad de los resultados potenciales, que en el mundo del cálculo preciso del riesgo.

¿CÓMO SE SALVÓ EL MUNDO?

En la semana del 15 septiembre de 2008 el capitalismo estuvo a punto de frenar en seco. Las autoridades estadounidenses fueron las que realmente salvaron el mundo en esa semana aterradora. Y no lo salvaron manipulando teorías y modelos elegantes de expectativas racionales, sino experimentando y recurriendo a su conocimiento de lo que había salido mal en la Gran Depresión de los años treinta.

Fue fortuito que el Presidente de la Reserva Federal en ese momento, Ben Bernanke, fuera una reconocida autoridad académica sobre la Gran Depresión. Él sabía, por encima de todo, que había que proteger a los bancos. Puede parecer monstruosamente injusto que los banqueros escapen al castigo –en efecto es injusto– pero la lección perdurable de los años treinta es que en una crisis financiera hay que defender a los bancos.

Hay que reconocer que las autoridades hicieron el experimento de permitir que Lehman quebrara. Pero muy pronto se hizo evidente que una repetición tenía el riesgo del colapso total del capitalismo occidental. Desde entonces ninguna autoridad monetaria ha intentado repetir este experimento.

Hubo mucha publicidad y controversia en torno al Programa de Alivio de los Activos en Problemas (TARP), que requería aprobación política y por ello fue adoptado a plena luz del proceso democrático en Estados Unidos. Pero en cierta forma era de importancia secundaria para las acciones puramente administrativas de las autoridades estadounidenses, que: nacionalizaron las principales compañías hipotecarias, nacionalizaron efectivamente el AIG, e liminaron los bancos de inversión, forzaron las fusiones de bancos comerciales gigantes y garantizaron los fondos de inversión en el mercado de dinero.

Esto último en particular ha atraído muy poca atención, pero fue esencial. Los fondos de inversión en el mercado de dinero mantienen activos de muy corto plazo y, en consecuencia, están obligados a mantener activos de alta calidad y de alta liquidez. En efecto, están obligados a mantener un dólar de activos por cada dólar prestado. Pero el 16 de septiembre, el Reserve Primary Fund6 hizo una provisión sobre las acciones de Lehman Brothers, y el valor de sus participaciones cayó a 97 centavos por dólar. Esto casi desata una corrida masiva en todo el sistema bancario. Si hubiese ocurrido, una consecuencia inmediata habría sido el cierre de los cajeros automáticos, y los consumidores habrían tenido dificultades para tener dinero en efectivo. Las compañías no habrían podido refinanciar su deuda de corto plazo, y si no hubieran tenido efectivo en caja para cubrirla habrían tenido que declararse en bancarrota.

En suma, el incumplimiento de los fondos de inversión fácilmente habría desatado una profunda recesión. Pero el 19 de septiembre, la Tesorería de Estados Unidos anunció que garantizaría las tenencias de activos de todos los fondos de inversión públicos que participaran, pagando una cuota, en el programa.

El punto clave con respecto a todas estas acciones es que las autoridades estadounidenses no prestaron ninguna atención a la teoría macroeconómica académica de los últimos treinta años: la teoría del ciclo real, los modelos estocásticos de equilibrio general dinámico, las expectativas racionales. Todos los miles de artículos eruditos sobre estos temas bien podrían no haber sido escritos jamás. En cambio, las autoridades actuaron. Actuaron de manera imperfecta, en condiciones de enorme incertidumbre, aprovechando las lecciones de los años treinta y esperando que pudieran evitar los errores de ese período. No fue un plan grandioso, ni un plan que alguna vez hubiese existido. Fue un proceso en el que las personas respondían a los acontecimientos con base en un conocimiento imperfecto, probando y examinando lo que hacían y lo que no parecía funcionar.

Hasta ahora parece haber funcionado. En el momento de escribir este artículo se observa que el PIB de Estados Unidos en 2009 caerá en un 3% o un 4% con respecto a 2008, y que la economía se está estabilizando. En contraste, entre 1929 y 1930, el primer año de la Gran Depresión, el PIB cayó en cerca del 9%, y la caída acumulada entre 1929 y 1933 fue del 27%. Por supuesto, no conocemos las consecuencias de mediano y más largo plazo. Una de ellas podría ser que el dólar pierda su estatus de moneda de reserva. Durante muchos años, Estados Unidos ha podido financiar su déficit de balanza de pagos imprimiendo dólares y entregándolos al resto del mundo, un proceso que hasta ahora ha satisfecho a todos los interesados. El enorme incremento de la deuda pública estadounidense que se ha destinado a los programas de rescate puede poner esto en cuestión. Pero ésta es una mera especulación. En cambio, sí sabemos que el programa de estabilización ha funcionado hasta ahora, y que se ha evitado un colapso catastrófico del producto.

LO QUE SALIÓ MAL: ¿UN MEA CULPA?

Poco después de su documento de trabajo del MIT sobre la economía, de agosto de 2008, Olivier Blanchard escribió otro ensayo de la serie, que apareció en enero de 20097. Aquí dio un giro notable, que recuerda otra frase famosa de Keynes: Cuando los hechos cambian, cambio de ideas. ¿Qué hace usted, señor?.

Blanchard identifica cuatro razones principales de la crisis.

Primera: Se crearon, vendieron y compraron activos que parecían mucho menos riesgosos de lo que eran realmente.

¡Exactamente! Blanchard da el ejemplo de las hipotecas subprime. Pero sus severas críticas se podrían aplicar igualmente al mundo más complicado de los derivados, donde la probabilidad de cambios de precios muy grandes fue burdamente subestimada por los modelos convencionales de fijación de precios.

Este problema de las colas gruesas había sido bien establecido, más allá de toda duda, por la investigación en econofísica, pero fue totalmente ignorado. Los grandes cambios de precios de los activos no son frecuentes, pero ocurren con mucha mayor frecuencia de la que implica el supuesto convencional de que siguen la distribución de probabilidad normal de Gauss.

Blanchard se pregunta por qué ocurrió esto: La historia nos enseña que los ambientes económicos benignos a menudo llevan a explosiones de crédito, a la creación de activos marginales y a la emisión de préstamos marginales. Los prestatarios y los prestamistas observan las distribuciones históricas recientes de los rendimientos y se vuelven más optimistas, de hecho demasiado optimistas acerca de los rendimientos futuros.

Estamos en un mundo alejado de los modelos de racionalidad y DSGE. De hecho, regresamos al mundo de Keynes y de Hayek, donde los agentes pueden cometer errores persistentes, y donde aun el banco central no aprende del pasado.

Segunda: La titularización hizo más complejo y difícil valorar los activos de los balances de las instituciones financieras.

Las matemáticas para fijar el precio aun del derivado más simple son bastante difíciles8, pero el carácter verdaderamente exótico de muchos de los productos que se crearon significa que ni el comprador ni el comprador tenían una buena aproximación de la distribución de probabilidad de los resultados probables. En otras palabras, enfrentaban un mundo en el que la incertidumbre era aún más importante que el riesgo.

Tercera: La titularización y la globalización aumentaron la conectividad entre instituciones financieras, dentro y entre países.

Tenemos que ser muy cuidadosos al sacar conclusiones sobre el grado de conectividad y la vulnerabilidad de un sistema ante una cascada global luego de un choque. La mayor conectividad puede en principio fortalecer en vez de debilitar el sistema. Pero dadas las proporciones de activos líquidos ridículamente bajas con las que operaban los bancos, parece plausible que éste fue un factor que contribuyó a la crisis.

Cuarta: Apalancamiento incrementado.

Blanchard traduce servicialmente esto al inglés: Las instituciones financieras financiaron sus portafolios con un capital cada vez menor y así aumentaron la tasa de rendimiento de ese capital. ¿Cuáles fueron las razones? Seguramente, el optimismo y la subestimación del riesgo fueron de nuevo parte de ello. Es superfluo hacer comentarios adicionales.

En este último artículo, Blanchard descarta en forma impresionante todo el corpus de la teoría macroeconómica predominante en los últimos treinta años.

BREVE CONCLUSIÓN

La macroeconomía moderna, que se basa en los agentes racionales y las expectativas racionales (RARAS), tiene gran parte de la responsabilidad por la crisis financiera.

La disciplina proporcionó el fundamento intelectual para un mundo en el que las situaciones que involucran riesgo fueron subestimadas sistemáticamente, y en el que las situaciones de incertidumbre auténtica no eran reconocidas por lo que eran.

Seguramente es hora de desechar de una vez por todas esta visión RARA del mundo. Los bancos centrales deberían enterrar sus modelos DSGE. Las agencias financiadoras deberían dejar de apoyar las propuestas RARAS. La evidencia científica proporcionada por el experimento de la crisis financiera debería permitirnos sacar estas conclusiones. ¿Pero algo de esto ocurrirá? Temo que me pidan que especule acerca de un mundo donde la incertidumbre rige realmente. En algún punto se abandonará la visión RARA, pero ésta ya ha sido sometida a lo que un observador desapasionado consideraría demasiadas falsaciones empíricas, y no soy muy optimista.

NOTAS AL PIE

1. El autor usa en todo el artículo el término RARE, que corresponde a las siglas en inglés de la expresión rational agent using rational expectations; en la traducción se usa como adjetivo en versalitas (N. del T.).

2. Una clasificación estadística de la magnitud y la duración de las recesiones en el capitalismo desde 1870 se presenta en Ormerod (2009).

3. Una crítica inicial y poderosa es la de Summer (1986).

4. Ha habido intentos de identificar los factores monetarios como fuente de los choques en esta teoría, pero sin éxito.

5. Ver por ejemplo Watts (2002) y Ormerod y Colbaugh (2006).

6. Éste era su nombre, y no tenía conexión con la Reserva Federal.

7. Blanchard (2009).

8. El artículo seminal es de Black y Scholes (1973).

REFERENCIAS BIBLIOGRÁFICAS

1. Bank of England. Financial Stability Report, October, 2008. [ Links ]

2. Bank of England. Bank of England Quarterly Bulletin, October, 2008. [ Links ]

3. Black, F. y M. Scholes. The Pricing of Options and Corporate Liabilities, Journal of Political Economy 81, 1973, pp. 637-654. [ Links ]

4. Blanchard, O. J. The State of Macro, MIT Department of Economics Working Papers 08-17, 2008. [ Links ]

5. Blanchard, O. J. The Crisis: Basic Mechanism and Appropriate Policies, MIT Department of Economics Working Paper s 09-01, 2009. [ Links ]

6. Hayek, F. A. The Pretence of Knowledge, American Economic Review 79, 1989, pp. 3-7. [ Links ]

7. Keynes, J. M. The General Theory of Employment, Interest and Money, London, MacMillan, 1936. [ Links ]

8. Laloux, L.; P. Cizeau; J. P. Bouchaud, y M. Potters. Noise Dressing of Financial Correlation Matrices, Physical Review Letters 83, 1999, 1467. [ Links ]

9. Mandelbrot, B. B. The Variation of Certain Speculative Prices, Journal of Business 36, 1963, pp. 394-419. [ Links ]

10. Ormerod, P. y R. Colbaugh. Cascades of Failure and Extinction in Evolving Complex Systems, Journal of Artificial Societies and Social Simulation 9, 4, 2006. [ Links ]

11. Ormerod, P. Risk, Recessions and the Resilience of the Capitalist Economies, Risk Management 12, 1, 2010, pp. 83-99. [ Links ]

12. Plerou, V.; P. Gopikrishnan; B. Rosenow; L. A. Nunes, y H. E. Stanley. Universal and Non-Universal Properties of Cross Correlations in Financial Time Series, Physical Review Letters 83, 1999, pp. 1471-1474. [ Links ]

13. Summers, L. H. Some Skeptical Observations on Real Business Cycle Theory, Federal Reserve Bank of Minneapolis Quarterly Review 10, 1986, pp. 23-27. [ Links ]

14. Tovar, C. E. DSGE Models and Central Banks, Economics E-Journal 3, 2009, [http://www.economics-ejournal.org/economics/journalarticles/2009-16]. [ Links ]

15. Watts, D. J. A Simple Model of Global Cascades on Random Networks, Proceedings of the National Academy of Science 99, 2002, pp. 5776-5771. [ Links ]

16. Woodford, M. Convergence in Macroeconomics: Elements of the New Synthesis, American Economic Journal: Macroeconomics 1, 1, 2009, pp. 267-279. [ Links ]