Servicios Personalizados

Revista

Articulo

Indicadores

-

Citado por SciELO

Citado por SciELO -

Accesos

Accesos

Links relacionados

-

Citado por Google

Citado por Google -

Similares en

SciELO

Similares en

SciELO -

Similares en Google

Similares en Google

Compartir

Revista de Economía Institucional

versión impresa ISSN 0124-5996

Rev.econ.inst. v.12 n.22 Bogotá ene./jun. 2010

LA CRISIS

THE CRISIS

Alan Greenspan*

* Doctor en Economía, ex Presidente de la Junta de Reserva Federal y Presidente de Greenspan Associates LLC, Washington, Estados Unidos. Fecha de recepción: 18 de marzo de 2010, fecha de modificación: 6 de abril de 2010, fecha de aceptación: 1.° de julio de 2010. Artículo original en inglés. Traducción de Mauricio Pérez Salazar y Alberto Supelano.

RESUMEN

[Palabras clave: crisis económica, intermediación financiera; JEL: E32, E44]

Este artículo revisa las causas de la crisis, explora la naturaleza de la intermediación financiera, presenta un conjunto de reformas para superar las deficiencias de la estructura reguladora y examina el papel de la política monetaria en la crisis actual. Concluye que es primordial aumentar los requerimientos regulatorios de capital y de liquidez de los bancos e incrementar en forma significativa las garantías obligatorias de los productos financieros que se negocian globalmente.

ABSTRACT

[Keywords: economic crisis, financial intermediation; JEL: E32, E44]

This article reviews the causes of the crisis, explores the nature of financial intermediation, presents a set of reforms to overcome the deficiencies of the regulatory structure and examines the role of monetary policy in the current crisis. It concludes that it is essential to increase regulatory capital requirements and liquidity of banks and increase the guarantees of financial products that are traded globally.

La bancarrota de Lehman Brothers en septiembre de 2008 precipitó lo que en retrospectiva quizá sea la crisis financiera mundial más virulenta que se haya registrado. Por supuesto, la contracción subsiguiente de la actividad económica ha sido menor a la Gran Depresión de los años treinta. Pero la virtual desaparición del crédito privado de corto plazo, a una escala tan global, el elemento principal de la crisis financiera, no tiene antecedentes en nuestra historia financiera. El colapso de la supervisión privada del riesgo de contraparte, afinada a lo largo de muchas décadas, y el fracaso del sistema de regulación global exigen la cuidadosa revisión que los gobiernos han emprendido.

La tesis central de este escrito es que durante los años anteriores a esta crisis la intermediación financiera intentó funcionar con una capitalización muy endeble, debido a una mala interpretación del nivel de riesgo incorporado en unos productos y unos mercados financieros cada vez más complejos.

En la primera sección se revisan las causas de la crisis. En la segunda sección se explora la naturaleza de la intermediación financiera, en la tercera sección se presenta un conjunto de reformas para superar las deficiencias de la estructura reguladora existente, en la cuarta sección se examina el papel de la política monetaria en la crisis actual; la última sección presenta las conclusiones.

CAUSAS DE LA CRISIS

EL MERCADO GLOBAL ARBITRADO DE BONOS Y LA CRISIS DE LA VIVIENDA

El detonador inmediato de la crisis actual fue la proliferación global de hipotecas subprime tóxicas titularizadas de Estados Unidos. Pero a mi juicio sus orígenes se remontan a las secuelas de la Guerra Fría.

La caída del Muro de Berlín dejó al descubierto el desastre económico causado por el sistema económico del bloque soviético1. En respuesta, los mercados competitivos, silenciosa pero rápidamente, desplazaron a la desacreditada planificación centralizada que prevalecía en el bloque soviético y el entonces Tercer Mundo.

Un buen número de naciones del otrora Tercer Mundo, especialmente China, replicaron el exitoso modelo económico orientado a la exportación de los Tigres Asiáticos: una fuerza laboral bien educada y de bajo costo unida a la tecnología del mundo desarrollado y protegida por el fortalecimiento gradual del imperio del derecho desató un crecimiento económico explosivo2. El FMI estimó que en 2005 más de US$800 millones de miembros de la fuerza laboral del planeta se incorporaron a los mercados de exportación y, por tanto, competitivos; un incremento de US$500 millones desde la caída del Muro de Berlín (IMF, 2007, cap. 5, 162). Cientos de millones de trabajadores adicionales quedaron expuestos a las fuerzas competitivas domésticas, especialmente en la antigua Unión Soviética. Como resultado, entre 2000 y 2007 el crecimiento del PIB real del mundo en desarrollo fue más del doble que el del mundo desarrollado.

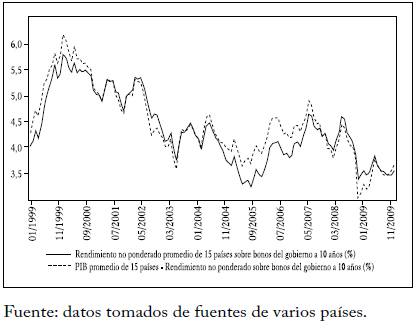

La consecuencia fue una caída pronunciada de las tasas de interés mundiales de largo plazo, nominales y reales (Desroches y Francis, 2007) entre 2000 y 2005 (gráfica 1), que indicaba que las intenciones mundiales de ahorro habían sido crónicamente mayores que las intenciones mundiales de inversión. En el mundo en desarrollo, el consumo restringido por la cultura y la inadecuada financiación de los consumidores no pudo mantener el ritmo del aumento del ingreso y, en consecuencia, su tasa de ahorro ascendió del 24% del PIB nominal en 1999 al 34% en 2007, superando de lejos a la tasa de inversión.

Pero la tasa de ahorro-inversión mundial ex post en 2007, en conjunto, sólo fue ligeramente mayor que en 1999, lo que indica que la tendencia ascendente de las intenciones de ahorro de las economías en desarrollo no fue acorde con la baja de las intenciones de inversión en el mundo desarrollado. El estudio del Banco de Canadá de marzo de 2007 (ibíd.) también llegó a la conclusión de que el debilitamiento de la inversión mundial fue el principal determinante del descenso de las tasas reales de interés mundiales de largo plazo. Por supuesto, bien fuese un exceso de intenciones de ahorro o un déficit de intenciones de inversión, la conclusión es la misma: menores tasas de interés reales de largo plazo.

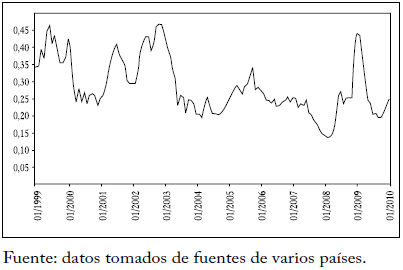

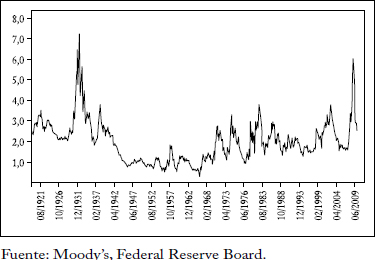

Las tasas de inflación y de largo plazo de todas las economías desarrolladas y de las principales economías en desarrollo convergieron a un solo dígito en 2006, creo que por vez primera. La ruta de convergencia es evidente en la varianza no ponderada de las tasas de interés de la deuda soberana a diez años de 15 países, que descendió marcadamente entre 2000 y 2005 (gráfica 2)3. La tasas de capitalización de las acciones y de la finca raíz fueron inevitablemente arbitradas hacia abajo por la caída de las tasas de interés reales mundiales de largo plazo. Por tanto, los precios de los activos, en particular los de la vivienda, se elevaron dramáticamente.

Gráfica 2

Varianza de la tasa de interés de largo plazo sobre la deuda soberana a 10 años, no ponderada

Los análisis de The Economist documentan la notable convergencia de los aumentos del precio de la vivienda en 20 países durante la última década4. Japón, Alemania y Suiza (por razones diversas) son las únicas excepciones importantes. En su pico, el alza de precios en Estados Unidos no fue mayor que el promedio del pico mundial (IFM, 2008). En resumen, los eventos geopolíticos llevaron a una caída de las tasas de interés hipotecarias de largo plazo, que a su vez llevó, con un rezago, a un alza extraordinaria e insostenible de los precios de la vivienda en el mundo.

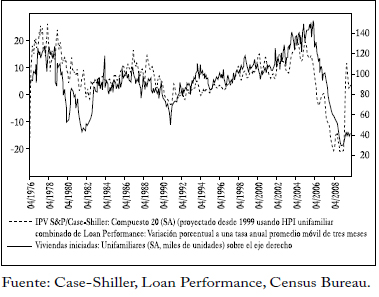

TITULARIZACIÓN DE SUBPRIMES: LA TRAMA DE LA CRISIS AL DESCUBIERTO

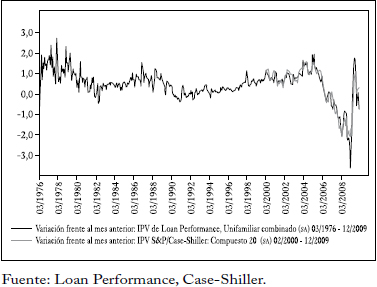

Durante años, en Estados Unidos las hipotecas subprime fueron un pequeño apéndice del mercado hipotecario de la vivienda, y en una fecha tan reciente como 2002 sólo representaron el 7% del total de hipotecas originadas. La mayoría de esos préstamos eran hipotecas con tasa de interés fija, y sólo una pequeña cantidad se había titularizado. A medida que el precio de la vivienda ascendía cada vez más rápidamente desde 1997 (gráfica 3), esos préstamos subprime se hacían más atractivos para los inversionistas.

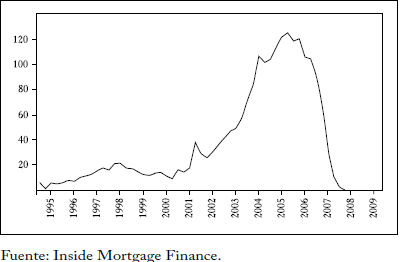

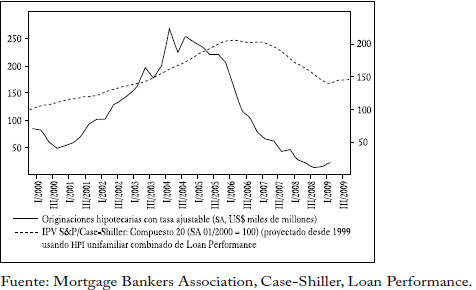

Cuando llegaron con cierto retraso a este mercado a finales de 2003, las firmas financieras empezaron a acelerar la agrupación y el empaquetamiento de hipotecas de vivienda subprime en títulos (gráfica 4). Esas firmas encontraron compradores receptivos. Los inversionistas nacionales y extranjeros, sobre todo europeos5, fueron atraídos por el rendimiento de estos títulos, mayor que el promedio, y por una tasa de ejecución de las hipotecas subyacentes que había disminuido durante dos años.

Gráfica 4

Emisión trimestral de títulos hipotecarios subprime

(SA, US$ miles de millones)

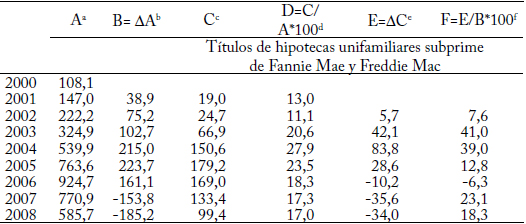

Otro factor que contribuyó al rápido aumento de la demanda fueron las grandes compras de títulos subprime realizadas por Fannie Mae y Freddie Mac, las grandes empresas patrocinadas por el gobierno de Estados Unidos (EPG). Presionadas por el Departamento de Vivienda y Desarrollo Urbano6 y por el Congreso para que ampliaran las metas de vivienda asequible, decidieron cumplirlas invirtiendo fuertemente en títulos subprime. Se estima que esas firmas poseían un 40% de los títulos hipotecarios subprime emitidos (casi todos con tasa variable) durante 2003 y 2004 (cuadro 1)7. Una participación estimada cinco veces mayor que en 2002, lo que implica que una gran proporción del aumento de la demanda de títulos subprime respaldados por hipotecas en 2003-2004 fue decidida políticamente y por tanto motivada por una demanda altamente inelástica.

Cuadro 1

(US$ miles de millones)

a: Total de títulos hipotecarios subprime vigentes; b: cambio en el total de títulos hipotecarios subprime vigentes; c: mantenidos en portafolio; d: como porcentaje del total de títulos hipotecarios subprime vigentes; e: variación desde finales del año anterior, y f: variación como porcentaje del cambio en el total de títulos hipotecarios subprime vigentes. Datos estimados parcialmente por el autor. Todos los datos de Fannie Mae de 2002 a 2008 son reales. Para los datos de 2001 se separó el total publicado que combinaba subprime y Alt-A. Como guía se tomaron los títulos vigentes a finales de 2002 (casi todos ARM). Todos los datos de Freddie Mac de 2006 a 2008 son reales. Los datos anteriores combinaban subprime y Alt-A y para separarlos utilicé la división disponible para 2006. En la anterior separación se emplearon otros datos sobre la división entre tasa fija y ARM (predominantemente subprime).

Fuente: FHFA, Annual Report to Congress, 2008 (revisado), Loan Performance.

En el primer trimestre de 2007, prácticamente todas las originaciones subprime estaban titularizadas (frente a la mitad en 2000) (IMFP, 2009), y los títulos hipotecarios subprime vigentes totalizaban más de US$900 mil millones de dólares, un incremento de más de seis veces desde finales de 2001.

Los titularizadores, empaquetando rentablemente esta nueva fuente de papeles en conjuntos de hipotecas y armados con lo que en retrospectiva resultaron ser calificaciones de crédito burdamente infladas, podían vender cantidades aparentemente ilimitadas de títulos hipotecarios subprime en lo que parecía ser un mercado mundial enorme y receptivo. En cuanto los estándares de aprobación de los préstamos se deterioraron rápidamente8, las originaciones de hipotecas subprime se inflaron en 2005 y 2006 a un burbujeante 20% del total de originaciones de hipotecas de vivienda de Estados Unidos, casi el triple de su participación en 2002.

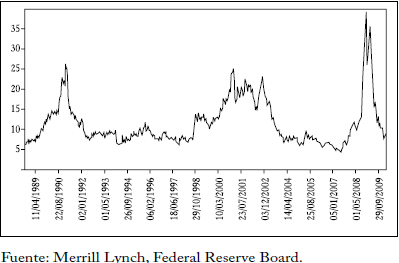

UNA BURBUJA DE EUFORIA CLÁSICA COBRA FUERZA

Como indicación de que el apetito por el riesgo se había extendido más allá del mercado de hipotecas titularizadas, los durante largo tiempo sacrosantos convenios de deuda9 se flexibilizaron cuando cobró fuerza una clásica burbuja de euforia global. Para 2007, los márgenes de rendimiento en los mercados mundiales de deuda se habían estrechado hasta un punto en que había poco espacio para subvalorar aún más el riesgo. Nuestro indicador más amplio del riesgo de crédito, el margen de rendimiento de los bonos calificados con CCC o de menor calidad (contra los bonos del Tesoro a 10 años) cayó a un mínimo histórico en la primavera de 2007, aunque sólo marginalmente (gráfica 5). Casi todos los agentes del mercado que yo conocía eran conscientes del aumento de los riesgos, pero también sabían que el riesgo se había subvalorado durante años. Yo hablé del espectro de la exuberancia irracional en 199610, sólo para ver que la burbuja puntocom, después de un traspiés de un día, siguió inflándose durante cuatro años más sin que la contuviera un incremento acumulado de 350 puntos básicos en la tasa de fondos federales entre 1994 y 2000. En forma similar, en 2002 expresé mi preocupación ante el Comité Federal de Mercado Abierto (FOMC) de que nuestro extraordinario auge de la vivienda [...] financiado por incrementos muy grandes de la deuda hipotecaria, no puede continuar indefinidamente. Y duró hasta 200611.

Gráfica 5

Margen diario de rendimiento: Títulos CCC y de menor calificación menos Bonos del Tesoro a 10 años, (% p.a.)

4 de agosto de 1988 a 5 de marzo de 2010

Es claro que con esas experiencias en mente las empresas financieras temían que si reducían su exposición demasiado pronto, casi con seguridad perderían participación en el mercado, quizá en forma irremisible. Sus temores se sintetizaron en el hoy famoso comentario de Charles Prince, del Citigroup, en 2007, poco antes del inicio de la crisis: Cuando la música pare, en términos de liquidez, las cosas se complicarán. Pero mientras siga la música, uno tiene que pararse y bailar. Todavía estamos bailando12.

Las empresas financieras se arriesgaron a prever a tiempo el inicio de la crisis, para reducir su exposición. Y se equivocaron. Creían que la demanda, entonces al parecer insaciable, de su gama de productos financieros exóticos les permitiría vender sin pérdidas gran parte de sus portafolios. No reconocieron que la transformación de la liquidez del balance contable en demanda efectiva es principalmente una función de la aversión al riesgo13. Ese proceso se manifiesta en períodos de euforia (la aversión al riesgo cae por debajo del promedio de largo plazo, que no tiene tendencia) y temor (la aversión al riesgo aumenta por encima del promedio). Una disminución de la intensidad de la aversión al riesgo reduce los márgenes entre precio de oferta y de demanda de activos, en volumen, la definición convencional de liquidez de mercado, en contraste con la liquidez del balance contable.

En este contexto, defino una burbuja como un período prolongado de descenso de la aversión al riesgo que se traduce en descensos de las tasas de capitalización que caen perceptiblemente por debajo de su promedio de largo plazo, que no tiene tendencia14. El descenso de las tasas de capitalización eleva el precio de uno o más activos a niveles insostenibles. Todas las burbujas estallan cuando la aversión al riesgo llega al mínimo irreductible, es decir, cuando los márgenes entre tipos de crédito se acercan a cero, aunque la capacidad de los analistas para predecir el inicio de la deflación ha probado ser ilusoria.

Algunas burbujas estallan sin consecuencias económicas graves; por ejemplo, la burbuja puntocom y la rápida alza de precios de las acciones en la primavera de 1987. Otras estallan con graves consecuencias deflacionarias. Como demostraron Reinhart y Rogoff (2009), este tipo de burbujas parece depender del grado de apalancamiento de la deuda en el sector financiero, en particular cuando el vencimiento de sus pasivos es menor que el vencimiento de los activos que financia.

Gráfica 6

Margen de rendimiento: Bonos corporativos BAA menos Bonos del Tesoro a 10 años

Enero de 1919 a febrero de 2010

Dudo mucho de que si en septiembre de 2008 los activos financieros hubieran estado financiados predominantemente con capital accionario en vez de deuda la deflación de los precios de los activos hubiese generado un efecto de contagio mayor que el de la burbuja puntocom. A este respecto es instructivo que ningún fondo de cobertura haya incumplido el pago de su deuda durante la crisis actual, a pesar de grandes pérdidas que llevaron a la liquidación de algunos.

¿POR QUÉ LLEGÓ LA BURBUJA A TALES ALTURAS?

¿Por qué la burbuja de 2007 alcanzó una euforia única en el siglo? Creo que la respuesta se encuentra en la burbuja puntocom que estalló con muy pocos efectos visibles sobre el PIB mundial; y, en Estados Unidos, en la recesión más suave del período posterior a la Segunda Guerra Mundial. Y, por cierto, la recesión anterior en Estados Unidos (1990-1991) fue la segunda menos profunda. Junto con el hecho de que la crisis bursátil de 1987, que no tuvo un impacto visible en el PIB, indujo a la Reserva Federal y a un buen número de inversionistas sofisticados a creer que las contracciones futuras tampoco serían peores que una recesión de posguerra típica.

La protección amortiguadora de los niveles de capital de los grandes bancos parecía cada vez menos apremiante en este período de Gran Moderación. Aún en abril de 2007 el FMI decía:

Los riesgos económicos mundiales han disminuido desde [ ] septiembre de 2006 [...] El conjunto de la economía de Estados Unidos se mantiene bien [y] las señales en otras partes son muy alentadoras (IMF, 2007, xii).

Las regulaciones de Basilea indujeron un modesto incremento de los requerimientos de capital antes de la crisis. Pero los debates de Basilea sobre reglas globales acerca de las exigencias de capital bancario, que resultaron en Basilea II, versaron principalmente sobre la alternativa entre requerimientos estables de capital bancario y un menor capital bancario. En consecuencia, el apalancamiento financiero se infló.

Es en tales circunstancias que dependemos de nuestro muy sofisticado sistema global de gestión del riesgo financiero para contener los colapsos del mercado. ¿Cómo pudo fallar a tan gran escala? El paradigma que engendró varios Premios Nobel de Economía15 fue acogido tan ampliamente por la academia, los bancos centrales y los reguladores que en 2006 se convirtió en el núcleo de los estándares de regulación global (Basilea II). Muchas firmas cuantitativas que, triturando cifras, buscaban estrategias rentables de negociación en el mercado tuvieron éxito mientras la aversión al riesgo se movió incrementalmente (lo que sucedió gran parte del tiempo). Pero triturar datos que sólo cubrían las dos o tres décadas anteriores a la crisis actual no produjo un modelo que pudiera prever una crisis.

Sin embargo, los modelos matemáticos que definen el riesgo son mejores guías para manejar el riesgo que los juicios a ojo de hace medio siglo. Hasta hoy es difícil encontrar fallas en el marco conceptual de nuestros modelos, hasta donde van. La elegante prueba de fijación de precios de las opciones de Fisher Black y Myron Scholes no es hoy menos válida que hace una década. No obstante, el paradigma del manejo de riesgo albergaba una falla fatal.

En el estado de alta y creciente euforia, los gerentes de riesgo, la Reserva Federal y otros reguladores no entendieron plenamente el tamaño subyacente, la duración y el impacto de cola negativa de la distribución de los resultados del riesgo que iban a ser revelados cuando la crisis estalló después de la quiebra de Lehman. Durante décadas, con pocos datos o ninguno, la mayoría de los analistas, en mi experiencia, había conjeturado un riesgo de cola mucho más limitado. Se puede argumentar que ésta es la causa principal de las fallas críticas del sistema de gestión del riesgo.

Un problema ligeramente menor fue la enorme y en algunos casos casi indescifrable complejidad de una amplia gama de productos y mercados financieros que se desarrollaron con el advenimiento de sofisticadas técnicas matemáticas para evaluar el riesgo16. En la desesperación, una parte excesiva de las decisiones de inversión se delegó a las valoraciones de riesgo puerto seguro de las agencias calificadoras de crédito. No se requería un juicio adicional de los funcionarios a cargo de las decisiones de inversión, por cuanto creían estar resguardados por los juicios de las calificadoras autorizadas por el gobierno.

Pero a pesar de décadas de experiencia, los analistas de las agencias calificadoras de crédito probaron no ser más competentes para prever el inicio de la crisis que la comunidad inversionista en general.

Aun con el fracaso de nuestros sofisticados modelos de manejo de riesgo, se puede argumentar que el sistema financiero se habría mantenido incólume si el segundo baluarte contra la crisis –nuestro sistema regulador– hubiese funcionado eficazmente. Pero, bajo la presión de la crisis, también fracasó.

Los bancos comerciales y de ahorro de Estados Unidos están regulados ampliamente, y aunque durante años nuestras 10 o 15 entidades bancarias más grandes han tenido revisores permanentes in situ para supervisar las operaciones diarias, muchos de estos bancos compraron activos tóxicos. La muy elogiada Autoridad de Servicios Financieros del Reino Unido no pudo prever y evitar el retiro masivo de depósitos bancarios que amenazó a Northern Rock. Las veneradas agencias calificadoras de crédito dieron calificaciones que permitieron prosperar en el mercado a muchos derivados altamente tóxicos con el sello AAA. El Comité de Supervisión Bancaria de Basilea, en representación de las autoridades reguladoras de los principales sistemas financieros del mundo, promulgó un conjunto de normas de capital incapaces de prever la necesidad –en el momento álgido de la crisis– de requerimientos de capital y de liquidez mucho mayores.

LA INTERMEDIACIÓN FINANCIERA

EL PROPÓSITO DE LAS FINANZAS

El fin último de la estructura y la regulación financiera en una economía de mercado es dirigir el ahorro de cada nación y el que se obtiene en préstamo del extranjero (el déficit en cuenta corriente) hacia inversiones en planta, equipo y capital humano que ofrecen los mayores incrementos del producto por hora en la nación. El producto no financiero por hora, en promedio, aumenta cuando las instalaciones obsoletas (con bajo producto por hora) son sustituidas por instalaciones que incorporan tecnologías de punta (con alto producto por hora). Este proceso mejora (en promedio) el nivel general de vida de toda la nación. El evidente éxito de las finanzas en las décadas anteriores al inicio de esta crisis para dirigir nuestros ahorros escasos a inversiones de capital real productivo parece explicar el grado en que los agentes de los mercados no financieros de Estados Unidos remuneraban los servicios financieros.

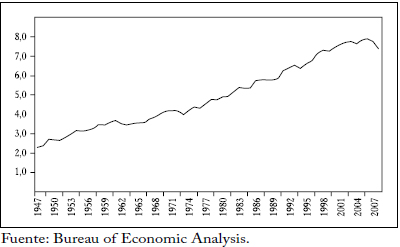

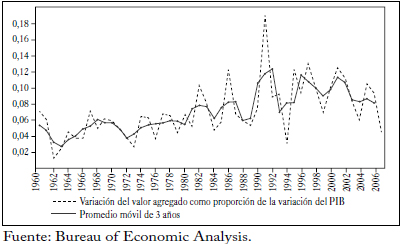

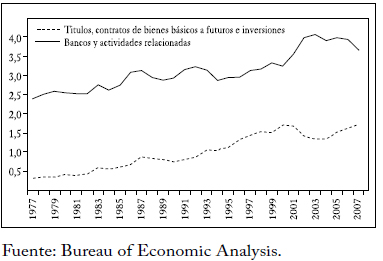

De acuerdo con la Oficina de Análisis Económico, la proporción del ingreso bruto de Estados Unidos que corresponde a las finanzas y a los seguros aumentó en forma casi continua del 2,3% en 1947 al 7,9% en 2006 (gráfica 7). Sólo una pequeña parte del aumento fue resultado de un aumento de la demanda extranjera neta de servicios financieros y seguros de Estados Unidos17. El descenso de la proporción al 7,4% en 2008 refleja el castigo al ahorro que se suponía empleado productivamente.

Gráfica 7

Valor agregado de los sectores financiero y de seguros

(porcentaje de PIB)

En vista del derrumbe histórico de los dos últimos años, ¿los participantes en los mercados no financieros malinterpretaron durante décadas la eficiencia del sector financiero y remuneraron en forma inadecuada a este pequeño segmento de nuestra economía? La ocurrencia de tantos fracasos de productos financieros así lo sugiere para el período que precedió a la crisis. Pero es difícil hacer ese mismo juicio frente al aumento más o menos persistente de la participación de este sector durante seis décadas18. Además, la participación del crecimiento de las finanzas en el crecimiento del PIB nominal carece de tendencia desde 1990, y promedia un 10% (gráfica 8)19. La proporción del empleo no agrícola atribuible a las finanzas y los seguros desde 1947 ha aumentado mucho menos que el ingreso bruto de estos sectores, lo que implica una mejora significativa de las habilidades y la remuneración de los trabajadores atraídos por las finanzas. Un estudio reciente indica un pronunciado aumento, superior al promedio, de los salarios de quienes están empleados en el sector financiero (Philippon y Reshef, 2008), lo que quizá refleje esa mejora. En 2007, una cuarta parte de los graduados del venerable Instituto Tecnológico de California entraron a dicho sector20.

Gráfica 8

Sectores financiero y de seguros: variación del valor agregado como proporción de la variación del PIB

¿Cómo debemos interpretar esta tendencia ascendente estable y extraordinariamente persistente? ¿Es del todo accidental? (después de todo, no hay evidencia de tal tendencia en los años de preguerra) No es que el valor de los activos que se deben manejar haya aumentado persistentemente con respecto al PIB21. La respuesta a esta pregunta importa mucho.

En el contexto de la reforma financiera, la pregunta crítica que se debe hacer es: ¿la participación creciente de los servicios financieros fue casual o es evidencia de que se requería una proporción creciente de servicios financieros en el PIB para intermediar una división del trabajo cada vez más compleja22?

Hago la pregunta porque muchas recomendaciones recientes de política reducirían la participación del ingreso financiero en el PIB. ¿Esas políticas afectarían el crecimiento de la productividad no financiera de Estados Unidos y nuestro nivel de vida? La pregunta más importante, en vista del fracaso reciente de la gestión del riesgo y de la regulación, es si el aumento de la regulación financiera en este momento inhibe o promueve (mediante una mayor estabilidad) el crecimiento económico. Necesitamos una comprensión más profunda del papel de la intermediación financiera en el crecimiento económico para responder esa pregunta.

LA INTERMEDIACIÓN FINANCIERA RIESGOSA

Un intermediario financiero no puede operar rentablemente sin asumir riesgos. Mantener únicamente títulos de deuda pública de corto plazo, cuyo riesgo es nulo, asegura contra pérdidas de cartera pero el margen del ingreso por intereses siempre será negativo. Por tanto, ese portafolio, con raras excepciones23, no puede ser financiado con ahorro privado sin pérdidas. Los intermediarios financieros no tienen entonces más opción que operar con apalancamiento y aceptar el riesgo que involucra.

Pero, ¿qué tanto riesgo se necesita para obtener una tasa competitiva de rendimiento del capital dedicado a la intermediación financiera? Es evidente que el nivel de apalancamiento promedio (el inverso de la relación entre capital social y activos) que los bancos pueden asumir y seguir siendo rentables aumentó drásticamente de menos de 2 antes de la Guerra Civil a 10 o más después de la Segunda Guerra Mundial. Los sistemas de pagos mejoraron y los préstamos agrícolas dejaron de predominar en la composición de la cartera bancaria estadounidense (en favor de los préstamos comerciales). Y la competencia se amplió.

Pero los promedios transmiten poca información relevante sobre la distribución del riesgo. Hasta la evidencia del impacto de Lehman se desconocía la forma de la distribución del riesgo de cola negativo extremo. Puesto que el riesgo de cola es indefinido24, al menos en principio, siempre habrá algún riesgo que no se puede cubrir con capital de los bancos y, por tanto, de que quiebren algunos e incluso muchos bancos. Pero eso no se convierte necesariamente en un problema sistémico si los requerimientos de capital social y de liquidez se elevan sustancialmente y se ordena que una parte significativa de la deuda de los intermediarios sean bonos de capital contingente25. Aún así, habrá la posibilidad, por remota que sea, de que el sistema de intermediación financiera privado tambalee, y requiera crédito soberano para seguir cumpliendo su vital función.

Durante mucho tiempo los banqueros centrales han sido conscientes del potencial de quiebras en los mercados financieros privados. De hecho, en Estados Unidos, tan recientemente como en 1991, pensando en lo impensable, y ante el apremio de la Junta de Gobernadores de la Reserva Federal, el Congreso examinó y enmendó la Sección 13-3 de la Ley de la Reserva Federal. La sección da autoridad prácticamente ilimitada a la Junta para otorgar préstamos en circunstancias inusuales y exigentes.

LA INUNDACIÓN DEL SIGLO

En referencia a este tema, hace una década señalé:

Existe [...] un difícil problema de manejo del riesgo que los banqueros centrales enfrentan cada día, reconozcámoslo explícitamente o no: ¿qué parte del riesgo subyacente de un sistema financiero debe recaer [exclusivamente] sobre los bancos y otras instituciones financieras? [Los bancos centrales] han decidido implícitamente, si no de manera más abierta, exigir niveles de capital y de reservas a los bancos para prevenir resultados adversos, pero sin contemplar los de aquellas crisis que ocurren una o dos veces en un siglo y que amenazan la estabilidad de nuestros sistemas financieros nacionales e internacionales.

No creo que ningún banco central haga este cálculo en forma explícita. Pero hemos elegido estándares de capital que por ningún esfuerzo de la imaginación nos pueden proteger contra todos los resultados adversos de pérdidas potenciales. En este ejercicio está implícita la admisión de que, en ciertos episodios, cuando sus sistemas de manejo del riesgo resultan ser inadecuados, los problemas de los bancos comerciales y otras entidades financieras serán resueltos por los bancos centrales. Al mismo tiempo, la sociedad en conjunto debe exigir que estos estándares sean muy altos. Las inundaciones del siglo sólo ocurren una vez cada cien años. Las instituciones financieras deberían pensar en recurrir al banco central únicamente en situaciones sumamente raras (Greenspan, 2000).

Está en discusión si la crisis actual es esa inundación del siglo. A lo sumo, las observaciones realizadas una vez en un siglo no pueden producir resultados robustos. Pero la evidencia reciente sugiere que la que sucedió después del colapso de Lehman es quizá la crisis financiera global más grave que haya ocurrido. En la Gran Depresión, por supuesto, el colapso del producto económico y el aumento del desempleo y la indigencia superaron de lejos a la situación actual, y para muchos, a la situación previsible futura de la economía mundial. Y, por supuesto, las quiebras bancarias generalizadas redujeron notablemente la disponibilidad de crédito de corto plazo. Pero los mercados financieros de corto plazo siguieron funcionando.

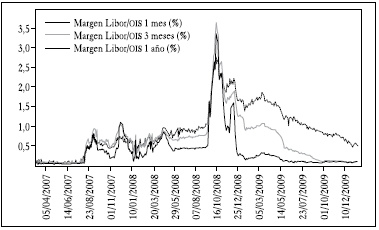

Las crisis financieras se caracterizan por una incapacidad progresiva para emitir, primero, deuda de largo plazo y, luego, de corto plazo, así como deuda interbancaria. La incertidumbre del futuro y, por tanto, el riesgo futuro, es siempre mayor que el riesgo de plazo más cercano; por ello los márgenes de riesgo siempre aumentan con el vencimiento de un instrumento financiero26. La profundidad de la crisis financiera es medida apropiadamente por el grado de colapso de la disponibilidad de crédito de corto plazo.

Creo que la evaporación de la oferta global de créditos de corto plazo unas horas o unos días después de la quiebra de Lehman no tiene precedente histórico. Una corrida de los fondos del mercado de dinero, que hasta entonces se percibían casi libres de riesgo, estaba en camino horas después del anuncio del cese de pagos de Lehman27. La Reserva Federal tuvo que actuar rápidamente para apoyar al desfalleciente mercado de papeles comerciales. Sin apoyo, la desaparición del crédito comercial desencadenó una espiral de colapso económico mundial en pocos días. Aun el casi sacrosanto mercado de repos plenamente colateralizados encontró graves dificultades sin precedentes.

Debemos explorar muy a fondo la historia financiera de tiempos de paz para descubrir episodios similares. El mercado de dinero a la vista, ese vehículo de la financiación de corto plazo clave en esa época, se clausuró en el pico del pánico de 1907, cuando no se ofrecía dinero a la vista a un día y la tasa solicitada aumentó del 1 al 125% (Homer y Sylla, 1991). Aun en lo más alto de la crisis bursátil de 1929, el mercado de dinero a la vista funcionaba, aunque las tasas ascendieron al 20%. En crisis financieras más moderadas, la disponibilidad de fondos en el mercado de largo plazo desapareció, pero el mercado interbancario y otros mercados de corto plazo siguieron funcionando.

La desaparición del crédito interbancario es la máxima estrechez financiera. Los inversionistas están dispuestos a prestar de un día para otro antes de que se sientan suficientemente protegidos por un capital adecuado para lograr vencimientos más lejanos y, por tanto, más riesgosos.

La evaporación de los créditos de corto plazo en septiembre de 2008 fue global y envolvente. Pero fue un proceso que ya habíamos observado antes, sólo que a nivel más micro28.

REFORMA DE LA REGULACIÓN

PRINCIPIOS DE LA REFORMA

En vista de este período de turbulencia prácticamente sin precedentes, ¿con qué estándar se debería juzgar la reforma de la supervisión y la regulación oficiales? No conozco ninguna forma de organización económica basada en la división del trabajo, desde el laissez-faire sin restricciones hasta la planificación centralizada opresiva, que haya logrado el máximo crecimiento económico sostenible y la estabilidad permanente. La planificación centralizada fracasó y dudo mucho que en las economías capitalistas se pueda lograr la estabilidad, puesto que los mercados competitivos siempre turbulentos son atraídos continuamente hacia el equilibrio, sin que jamás lo logren del todo (ese es el proceso que lleva al crecimiento económico).

Las personas que actúan sin previsión no pueden ser productivas, salvo por casualidad. La identificación de la innovación efectiva es, por necesidad, un acto racional. Por tanto, la inhibición del comportamiento irracional –cuando se lo puede identificar– mediante la regulación puede ser estabilizadora, como muestra la historia reciente. Pero la regulación tiene costos inevitables, en términos de crecimiento económico y nivel de vida, cuando se imponen restricciones que van más allá de contener el comportamiento improductivo.

Por su naturaleza, la regulación impone restricciones a los mercados competitivos. El punto elusivo del equilibrio entre crecimiento y estabilidad siempre ha sido tema de debate, especialmente en lo que atañe a la regulación financiera.

Durante los años de posguerra, con excepción de un número limitado de operaciones de salvamento de bancos estadounidenses29, el capital privado probó ser capaz de cubrir prácticamente todas las provisiones por pérdidas de cartera. Por tanto, nunca hubo una prueba definitiva de lo que entonces constituía la sabiduría convencional: que una relación entre capital social y activos del 6% al 10%, el rango que existió entre 1946 y 2003, era suficiente para respaldar al sistema bancario de Estados Unidos.

El supuesto de los gestores de riesgo sobre el tamaño de la cola negativa de la distribución del riesgo de crédito y de tasa de interés, como señalé más atrás, era, por necesidad, conjetural, y durante generaciones no tuvimos que probar esas conjeturas. En los años anteriores a la crisis, estaba totalmente documentado que la mayor parte de la forma de la distribución del riesgo percibido correspondía a crisis financieras moderadas y euforias representadas en la parte relevante de la curva. Pero desde cuando empezó la compilación moderna de datos financieros nunca tuvimos una inundación del siglo que revelara la plena intensidad de la cola negativa.

Las secuelas de la crisis de Lehman trazaron una cola negativa mucho mayor de lo que se hubiera imaginado previamente. Supongo, con esperanza más que con conocimiento, que ese fue de hecho el extremo de una posible crisis financiera que se pueda experimentar en una economía de mercado.

En las décadas anteriores, los gestores de riesgo sabían, por supuesto, que no era realista suponer que prevalecería la normalidad de la distribución del riesgo, sino que era una primera aproximación que facilitaba los cálculos. Las matemáticas de las colas gruesas eran bien entendidas, pero nuestra capacidad para triturar cifras era insuficiente para hacer los cálculos necesarios para guiar las decisiones, excepto a un costo prohibitivo. Ese ya no es el caso.

Es claro que lo que experimentamos en las semanas siguientes a la quiebra de Lehman es exactamente el tipo de espasmo del mercado que supuestamente captaba la conjetura del riesgo de cola, y que no se captó. Luego de la experiencia de Lehman, los gestores de riesgo serán mucho más cuidadosos al evaluar el riesgo futuro; al menos durante algún tiempo.

Muchas firmas de inversión están construyendo distribuciones de probabilidad de los resultados utilizando como cola negativa los datos basados en las experiencias de los dos últimos años. Empleando simulaciones de Monte Carlo u otras técnicas han concluido, no inesperadamente, que se habría predicho que la probabilidad de una crisis financiera tan grave como la actual es mucho mayor de lo que indican los modelos de distribución normal del riesgo. Dicha evidencia sugiere que una inundación del siglo se da con más frecuencia que una vez cada cien años.

La reforma más urgente que se debe realizar luego de la crisis es, a mi juicio, la del nivel de capital regulatorio ajustado por el riesgo de los activos. Lamentablemente, las evidentes posibilidades de que se haga trampa al sistema exigen una restricción adicional en forma de un requerimiento de capital tangible mínimo. Los requerimientos de capital regulador anterior a la crisis, basado en décadas de experiencia, calificaban los títulos de hipotecas de vivienda amortizables entre los instrumentos privados más seguros. Y, sorprendente y desafortunadamente, gran parte de las decisiones de portafolio de inversión fue subcontratada al (mal) juicio de las agencias de calificación de crédito.

Ese régimen es hoy desueto. Al parecer, los requerimientos de capital y de liquidez para los prestatarios individuales hoy se están ajustando al criterio revisado del mercado, según el cual la cola negativa de la distribución de riesgo se había subestimado. En consecuencia, como señalé antes, los mercados privados hoy están requiriendo capital económico y liquidez contable superiores a los de Basilea II, que muy pronto se enmendarán.

Según mi experiencia, los requerimientos de capital y liquidez pueden afrontar casi todas las deficiencias de la estructura de la regulación financiera que la crisis saca a la luz. En retrospectiva, debe haber un nivel de capital que habría evitado la quiebra de Bear Stearns y Lehman Brothers, por ejemplo (si no un 10%, pensemos en un 40%). Además, el capital tiene la ventaja reguladora de que no hay que pronosticar qué productos financieros particulares están a punto de volverse tóxicos. Los inversionistas no previeron el futuro de los títulos subprime ni de los innumerables productos adicionales que fallaron. Un capital adecuado elimina la necesidad de una especificidad inalcanzable en el afinamiento de la regulación.

Nuestra actual y hechiza estructura de regulación ha evolucionado durante décadas y se ha vuelto demasiado compleja. Durante los debates que llevaron a la legislación que se tradujo en una apertura necesaria a la competencia financiera (la Ley Gramm-Leach-Bliley), los diseñadores de política se equivocaron al no reconocer que el aumento de la competencia también incrementaba necesariamente el riesgo de cola negativo, lo que hacía necesarios unos requerimientos de capital más altos.

UN MAYOR CAPITAL ECONÓMICO

La cantidad de capital que hoy exigen las contrapartes influirá fuertemente en las próximas revisiones de los requerimientos de capital regulatorio.

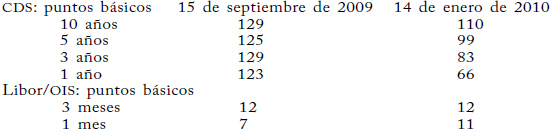

Es muy pronto para tener respuestas definitivas. Pero se pueden inferir aproximaciones muy toscas a partir de la respuesta de los CDS (credit default swaps) bancarios a los eventos posteriores a la crisis30. Sus movimientos también deberían darnos un indicio de cuándo regresará el sistema bancario al crédito amplio de los años anteriores a la crisis.

Empezando a finales de 2008 y acelerando en el primer trimestre de 2009, el Tesoro de Estados Unidos añadió US$250 mil millones al capital bancario a través del Programa de Alivio de los Activos en Problemas (TARP), el equivalente de unos dos puntos porcentuales de la relación entre capital social y activos. Su impacto fue importante e inmediato.

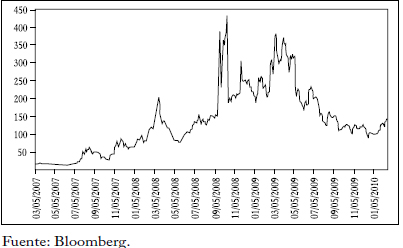

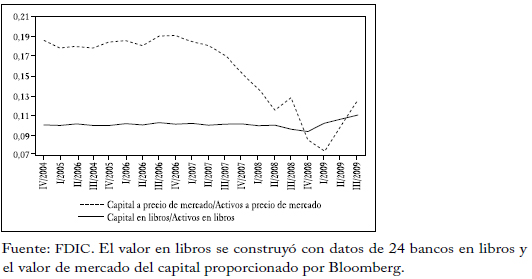

Cuando la crisis financiera se afianzó y se profundizó, el margen promedio no ponderado de los CDS a 5 años de los seis principales bancos de Estados Unidos31 ascendió de 17 puntos básicos a comienzos de 2007 a 170 puntos básicos justo antes del cese de pagos de Lehman el 15 de septiembre de 2008. En respuesta a la quiebra de Lehman, los CDS a 5 años se elevaron a más de 400 puntos básicos el 10 de octubre. El día en que se anunció el TARP (el 14 de octubre), los CDS a 5 años cayeron cerca de 200 puntos básicos, el 50% (gráfica 9). Una adición de dos puntos porcentuales a la relación entre capital social y activos en los libros de los bancos, que revirtió casi a la mitad el aumento de los CDS a 5 años debido a la crisis, implica que para financiar las obligaciones de los bancos los participantes en el mercado exigen un aumento adicional de 4 puntos porcentuales en el colchón de capital social (del 10% a mediados de 2007 al 14%). Esto supone una extrapolación lineal (un supuesto evidentemente hercúleo) y además la presunción de que la probabilidad de un TARP antes de Lehman era de m inimis. La brusquedad de la reacción del mercado al anuncio del TARP parece confirmar esa presunción.

Gráfica 9

CDS a 5 años: Promedio de Bank of America, JP Morgan, Citigroup, Goldman Sachs, Wells Fargo y Morgan Stanley

Las relaciones actuales entre capital y activos en libros están aún muy lejos del 14%. La relación entre capital y activos de los bancos comerciales era del 11,1% el 30 de septiembre de 2009 (según reportó la FDIC), en comparación con el 10,1% a mediados de 2007. Pero si se descontara la adición de más de US$500 mil millones a los activos de los bancos comerciales en forma de tenencias de saldos en la Reserva Federal (un activo de riesgo nulo) la relación entre capital y activos se elevaría al 11,7%. El FMI estimó en octubre pasado que las pérdidas de préstamos no reconocidas eran también de centenares de miles de millones de dólares. Las tendencias de la liquidez relevante se miden con menor facilidad, pero se suponen paralelas a las variaciones del capital.

Que los bancos aún deben adicionar más capital social también lo indican los CDS a 5 años del 31 de diciembre de 2009 (y desde entonces) con un precio cercano a 100 puntos básicos, aún muy alto con respecto al nivel de 17 puntos básicos que prevalecía a comienzos de 2007, cuando un capital del 10% era al parecer suficiente para eliminar prácticamente la amenaza de quiebra e inducir a los oficiales de crédito a prestar más libremente.

No hay duda de que la inyección de dinero del TARP redujo notoriamente el temor de quiebras bancarias a comienzos de 2009. Lo que es más difícil de juzgar es el impacto del dramático incremento del capital bancario a precio de mercado frente a los activos bancarios a precio de mercado sobre los CDS bancarios. Esa relación aumentó 5 puntos porcentuales desde finales de marzo de 2009 hasta finales de septiembre (del 7,4% al 12,6%)32(gráfica 10). No caben muchas dudas de que esto aumentó en forma significativa la solvencia de los bancos, aunque al parecer sólo con la mitad de la efectividad (dólar por dólar) del cambio más permanente del valor del capital social en libros33.

Gráfica 10

FDIC, bancos comerciales asegurados

Gran parte del reembolso de las inversiones del TARP al Tesoro de Estados Unidos se financió con la emisión de nuevo capital que se hizo posible con el incremento de US$650 mil millones del capital a precio de mercado de los bancos comerciales, y los préstamos se volvieron más fáciles (y más baratos) debido al aumento del colchón de capital engendrado por el aumento del capital bancario a precio de mercado. La contribución relativa del TARP y de ese aumento de capital a la solvencia bancaria y a la disposición a prestar no es del todo clara, aun en retrospectiva.

El TARP no sólo introdujo capital sino que indujo a los agentes del mercado a inferir que el Tesoro de Estados Unidos respaldaría las obligaciones del sistema bancario, al menos por un tiempo. Esto puede explicar la divergencia, desde septiembre de 2009, entre el Libor- OIS de corto plazo (de 1 a 3 meses)34 y los CDS a 5 y 10 años. A finales de septiembre de 2009 los márgenes Libor- OIS de corto plazo retornaron al nivel anterior a la crisis. Sólo una parte de los CDS de largo vencimiento retornó a ese nivel35. El Libor- OIS a un año se sitúa en el medio (gráfica 11). Es claro que los mercados están descontando parte del colchón del capital bancario a precio de mercado de aquí a cinco y diez años, debido a la volatilidad de los precios de las acciones o a que cuestionan la voluntad o la capacidad política del gobierno, después de que los mercados vuelvan a la normalidad, para iniciar otra operación de rescate bancario.

En vista del anterior conjunto de supuestos y conclusiones frágiles (es todo lo que tenemos) juzgaría que al final veremos que los requerimientos de capital social regulador habrán ascendido del 10% anterior a la crisis (en términos del valor en libros) al 13% o 14% en 2012, y que los requerimientos de liquidez se habrán endurecido en similar medida.

Los agentes del mercado también han aumentado el margen requerido y las garantías requeridas para las transacciones con intermediarios financieros no bancarios. En las transacciones con entidades no bancarias de todas las variedades que se conocen como banca en la sombra quizá sea mejor regular los productos financieros y no a las instituciones.

LO QUE LA REGULACIÓN PUEDE HACER

Según mi experiencia, lo que la supervisión y el examen pueden hacer para respaldar los requerimientos de capital y la gestión del riesgo de contraparte es promulgar normas preventivas que no requieran anticipar un futuro incierto. La supervisión:

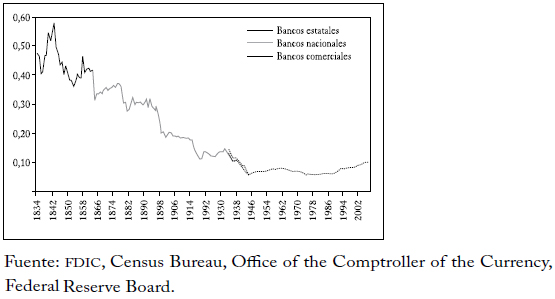

HISTORIA DEL CAPITAL REGULATORIO

A fines del siglo XIX, los bancos estadounidenses necesitaban un capital social del 30% de los activos para atraer los depósitos necesarios para financiar sus activos. En el período anterior a la Guerra Civil, esa cifra superó el 50% (gráfica 12). Dado el carácter rudimentario de los sistemas de pagos y la mala distribución geográfica de las reservas en una economía en ese entonces agrícola, la competencia por crédito bancario era sobre todo local. Permitió que los bancos nacionales obtuvieran un rendimiento neto promedio sobre activos de más de 200 puntos básicos a finales de la década de 1880 y quizá más de 300 puntos básicos en la de 1870 (en comparación con 70 puntos básicos un siglo después).

Gráfica 12

Relación entre capital propio total y activos totales

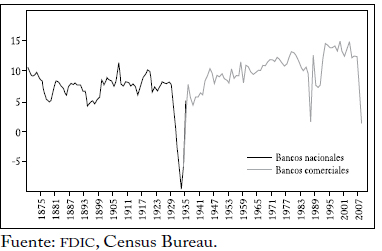

El aumento de la eficiencia de la intermediación financiera, debido a la consolidación de las reservas y a la mejora de los sistemas de pagos, presionó a través de la competencia para estrechar los márgenes y permitir que disminuyera la relación entre capital y activos. En marcado contraste, la tasa anual promedio de ingreso neto de los rendimientos del capital propio fue asombrosamente estable, y raras veces salió del rango del 5% al 10% anual durante el siglo transcurrido entre 1869 y 1966 (gráfica 13). Eso significa que el ingreso neto como porcentaje de los activos y el grado de apalancamiento fueron bastante proporcionales, y que se compensaban.

Gráfica 13

Ingreso neto como porcentaje del capital propio

Las tasas de rendimiento de los activos y del capital se elevaron levemente durante 1966-1982 (pese al descenso del apalancamiento)37 debido a la rápida expansión del ingreso no proveniente de intereses, de actividades fiduciarias, cargos y retribuciones por servicios, ingreso neto de la titularización (y más tarde de la banca de inversión y el corretaje). El ingreso no proveniente de intereses aumentó notoriamente entre 1982 y 2006 (incrementando el rendimiento neto sobre el capital en cerca del 15%) como consecuencia de la ampliación del alcance de las actividades autorizadas a los bancos.

Eso reflejó en parte el surgimiento en abril de 1987 de las entidades Sección 20, bancos de inversión filiales de las compañías de holding bancario, figura autorizada por los tribunales y regulada por la Reserva Federal38. El cambio de composición de los ingresos de ese negocio es claramente visible en la aceleración del crecimiento del ingreso bancario bruto con respecto al de los bancos de inversión que se inició en 2000 (gráfica 14)39.

Presumo que la estabilidad histórica del ingreso neto promedio con respecto al capital, que se remonta a los años posteriores a la Guerra Civil, refleja una tasa de rendimiento subyacente de la intermediación determinada ex ante por el mercado.

Gráfica 14

Valor agregado: Participación en el PIB nominal (%)

En resumen, la crisis actual dejará en su camino un requerimiento de capital a activos mucho más alto, económico y regulatorio, que se debe alcanzar para que la intermediación se restablezca hasta al punto en que los bancos y otros intermediarios confíen en que tienen un colchón de capital suficiente y seguro para prestar libremente.

LÍMITES A LOS REQUERIMIENTOS DE CAPITAL REGULATORIO

Cuando se determinan los niveles de capital regulatorio adecuado, es necesario reconocer que esa decisión no es independiente del alcance de la actividad bancaria regulada. El nivel de capital regulatorio tiene límites. Un banco, o cualquier intermediario financiero, necesita un apalancamiento significativo para ser competitivo. Sin apalancamiento adecuado, los mercados no proporcionan una tasa de rendimiento de los activos financieros suficientemente alta para atraer capital a esa actividad40. Pero con un grado de apalancamiento demasiado alto, la solvencia del banco queda en riesgo.

Para encontrar el equilibrio regulatorio necesitamos buscar la relación promedio entre capital y activos más alta que un sistema bancario puede tolerar antes de que un número significativo de bancos tenga que elevar su margen o reducir su tamaño41.

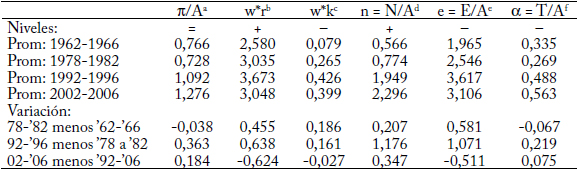

Ese problema es resoluble si tomamos como referencia la notable estabilidad de la relación entre ingreso neto y capital social (del 5% al 15%) que prevaleció con raras excepciones desde el final de la Guerra Civil (gráfica 13). Supongo una tasa de rendimiento anual promedio del 5% (el límite inferior del rango) como proxy de la distribución de todos los miles de bancos que compondrían el promedio. Tasa que para este ejercicio representa el rendimiento mínimo promedio de la intermediación requerido ex ante en condiciones de competencia. De ser así, la relación entre capital y activos más alta que puede tolerar el sistema bancario de Estados Unidos y seguir suministrando una capacidad financiera adecuada al sector no financiero se puede inferir a partir de la identidad:

π/C = (π/A)(A/C)

donde p es el ingreso neto, C el capital social y A los activos totales.

Si π/C = 0,05, C/A = 20(π/A).

Se puede demostrar que π/A = (rr – rp – k)w + n – e – α, donde rr es la tasa de interés que reciben los activos con rendimiento, rp la tasa de interés que se paga por los pasivos remunerados, k la relación entre pérdidas y activos con rendimiento, w la relación entre activos con rendimiento y activos totales, n la proporción entre ingreso no proveniente de intereses y activos, e la relación entre gastos diferentes de intereses y activos totales, y α el cociente de impuestos y otros ajustes menores sobre activos totales.

Como se puede ver en el cuadro 2, todo el aumento de π/A y π/C desde 1980 se debe al marcado aumento del ingreso no proveniente de intereses.

a: Ingreso neto dividido por el total de activos; b: Margen de la tasa de interés x participación del total de activos que reciben ingreso; c: Provisiones por pérdidas de préstamos y arriendos y transferencias de riesgo divididas por activos que reciben ingreso x participación del total de activos que reciben ingreso; d: Ingreso no proveniente de intereses dividido por el total de activos; e: Gasto diferente de intereses dividido por el total de activos, y f: Impuestos más rubros

menores netos divididos por el total de activos.

En los años inmediatamente anteriores al inicio de la crisis π/A promedió 0,012 y, por tanto, el capital regulatorio máximo promedio inferido, C/A, fue 0,24. Si todo lo demás es igual42, una tasa mayor de 0,24 llevaría la tasa de rendimiento promedio del capital por debajo del nivel crítico del 5%. Si π/A revirtiera y regresara al promedio del primer cuarto de siglo del período de posguerra (0,0075), entonces π/A = 0,0075 y C/A = 0,15, marginalmente superior a los requerimientos de capital del 12% al 14% presumiblemente determinados por el mercado, que inducirían a los bancos a prestar libremente.

Aunque estos cálculos se derivan de un modelo estático y es inevitable que sean imprecisos, destacan los trade-offs regulatorios entre requerimientos de capital y alcance de las actividades bancarias permisibles. Y sugieren que un requerimiento de capital del 13% al 14% de los activos deja gran libertad de acción a los reguladores para elevar los requerimientos de capital siempre que en el proceso no se restrinja indebidamente el alcance de las actividades bancarias.

En resumen, existe un límite superior al monto total de capital social que una firma financiera puede requerir para mantener sin presiones su tasa de rendimiento del capital por debajo de lo que la historia sugiere que es el 5% promedio competitivo mínimo. Debido a que la intermediación financiera requiere un apalancamiento significativo para ser rentable, los riesgos, a veces grandes, son inherentes a este proceso indispensable. Y en raras ocasiones la firma quebrará y podrá requerir la sustitución temporal de capital privado por crédito soberano.

DEMASIADO GRANDE PARA QUEBRAR

Más allá de aumentar significativamente los requerimientos de capital está la necesidad de enfrentar los problemas de algunas firmas financieras demasiado grandes para quebrar (DGPQ) o, en términos más adecuados, demasiado interconectadas para ser liquidadas rápidamente. El empleo productivo del ahorro escaso de la nación está siendo amenazado por firmas financieras al borde de la quiebra, respaldadas con fondos de los contribuyentes, a las que se denomina instituciones sistémicamente importantes. Estoy de acuerdo con Gary Stern, ex Presidente del Banco de la Reserva Federal de Minneapolis, quien por mucho tiempo ha sostenido que los acreedores seguirán subvalorando la toma de riesgos de estas instituciones financieras, financiándolas en exceso, sin proporcionar una disciplina de mercado efectiva. Ante precios demasiado bajos, las firmas sistémicamente importantes tomarán riesgos excesivos43. Estas firmas absorben los ahorros escasos que se necesita invertir en tecnologías de punta para que el producto por hora y el nivel de vida sigan aumentando.

Después de ser un asunto marginal en la ciencia económica durante años, el problema de demasiado grande para quebrar se convirtió en una importante y visible amenaza para el crecimiento económico. Se volvió un asunto de primera línea con la intervención de Fannie Mae y Freddie Mac el 7 de septiembre de 2008. Antes de esa fecha, los formuladores de política de Estados Unidos (con los dedos cruzados) podían señalar que Fannie y Freddie, por mandato legal, no estaban respaldas por la plena fe y el crédito del gobierno de Estados Unidos. Los agentes del mercado, sin embargo, no creyeron en la negación, y proporcionaron consistentemente a Fannie y Freddie un subsidio de crédito extraordinario. El 7 de septiembre de 2008, los agentes del mercado fueron finalmente vindicados44.

Un efecto muy perturbador del problema del salvamento de las firmas DGPQ, que se presentó desde la toma federal de Fannie Mae y Freddie Mac en septiembre de 2008, es que los agentes del mercado van a creer, si surge la ocasión, que toda entidad financiera importante será rescatada con dinero de los contribuyentes. Las empresas que sean rescatadas tienen ventajas de competitividad y de costo del capital, pero no ventajas de eficiencia, sobre las firmas que no se consideran sistémicamente importantes.

Durante años la Reserva Federal ha estado preocupada por el tamaño cada vez mayor de nuestras entidades financieras. Las investigaciones de la Reserva Federal no han podido encontrar economías de escala en la banca más allá de una entidad de tamaño modesto. Hace una década, citando esa evidencia (Berger y Humphrey, 1994, 7), señalé: los megabancos que se están formando con el crecimiento y la consolidación son entidades cada vez más complejas que generan un potencial de riesgos sistémicos inusualmente altos en la economía nacional e internacional si llegan a quebrar (Greenspan, 1999). Infortunadamente, poco hicimos para abordar el problema.

Las entidades que generan riesgos sistémicos son uno de los principales problemas de regulación para los que no hay buenas soluciones. La resolución anterior de los problemas bancarios bajo la Ley de Mejoramiento de la Corporación Federal de Seguros de Depósitos de 1991 (FDICIA) parece haber funcionado con bancos más pequeños durante períodos de prosperidad general. Pero la noción de que los riesgos se pueden identificar con la oportunidad suficiente para liquidar un gran banco con mínima pérdida probó ser insostenible en esta crisis y sospecho que lo será también en crisis futuras45.

A mi juicio, la solución que tiene al menos una posibilidad razonable de revertir el enorme riesgo moral46 que surgió el año pasado es exigir que los bancos y quizá todos los intermediarios financieros mantengan bonos de capital contingente, es decir, deuda que se convierta automáticamente en capital cuando el capital social caiga por debajo de cierto umbral. Dicha deuda, por supuesto, será más costosa que la emisión de bonos ordinarios, pero su existencia podría reducir notoriamente el riesgo moral.

Pero si los bonos de capital contingente resultan ser insuficientes deberíamos permitir que las entidades grandes quiebren, y si los reguladores juzgan que son demasiado interconectadas para liquidarlas rápidamente, llevarlas a una instancia especial de bancarrota. Eso daría al regulador el acceso a recursos fiscales para obtener créditos postconcordatarios. Una nueva ley crearía un panel de jueces expertos en finanzas. La ley exigiría que (cuando el capital esté totalmente agotado) los acreedores estén sujetos a principios legalmente definidos de descuento del valor nominal de sus acreencias (haircuts) antes de que el intermediario financiero sea reestructurado. La firma luego estaría obligada a dividirse en unidades independientes, ninguna de las cuales debería ser demasiado grande para quebrar.

Supongo que algunas de las firmas recién creadas sobrevivirán y otras quebrarán. Si después de un plazo fijo (¿un mes?) ninguna salida de la bancarrota parece viable, se deberá liquidar al intermediario financiero de la manera más expedita posible.

REGULACIONES QUE INCORPOREN PERMANENTEMENTE LAS FALLAS DE PREVISIÓN

La crisis actual demostró que ni los reguladores bancarios ni nadie más pueden pronosticar consistente y exactamente si las hipotecas subprime se volverán tóxicas o en qué grado, por ejemplo, o si un tramo particular de una obligación de deuda garantizada entrará en mora o incluso si el sistema financiero en conjunto se paralizará. Un alto porcentaje de esas difíciles previsiones será erróneo. Los reguladores pueden identificar fácilmente la subvaloración del riesgo y la existencia de burbujas, pero lo que es más importante, no pueden prever cuándo se iniciará una crisis, salvo por casualidad47. Esto no nos debería sorprender.

Una crisis financiera se define como un descenso fuerte y abrupto del precio de los activos con rendimiento, usualmente inducido por un brusco aumento de la tasa de descuento de los flujos de ingreso cuando los agentes del mercado pasan de la euforia al temor. Un corolario del cambio fuerte y súbito de precios es que no fue previsto por la mayoría de agentes del mercado. De otra manera, los desequilibrios de precios se habrían eliminado por el arbitraje.

Por cierto, años antes de agosto de 2007 se preveía que el evento que precipitaría la próxima crisis sería una fuerte caída del dólar a raíz del incremento dramático del déficit en cuenta corriente de Estados Unidos a partir de 2002. El dólar se vería en consecuencia sometido a fuertes presiones de venta. El aumento de la tasa de cambio euro-dólar, de 1,10 en la primavera de 2003 a 1,30 a finales de 2004, por ejemplo, parece haber eliminado gradualmente por arbitraje ese presunto detonador de la próxima crisis. El déficit en cuenta corriente de Estados Unidos no tuvo un papel directo importante en el inicio de la crisis de 2007, aunque pueda tenerlo en la próxima.

En los años venideros, los pronosticadores identificarán fácilmente el riesgo que está subvalorado, o al menos identificarán los riesgos cuyo precio es menor que el promedio histórico. Pero, como ya señalé, en un caso después de otro el riesgo estuvo subvalorado durante años. Los pronosticadores como grupo casi con certeza fallarán al prever el inicio de la siguiente crisis financiera, como han fallado tantas veces en el pasado, y presumo que cualquier regulador sistémico recién diseñado también fallará. En el actual ambiente de complejidad no veo una alternativa disponible distinta de aumentar en forma significativa los requerimientos de capital y liquidez regulatorios y reforzar la vigilancia del riesgo de contraparte de los bancos individuales.

La Reserva Federal ha estado preocupada durante años por la capacidad de los reguladores y encargados de la vigilancia y el control para prever la aparición de problemas que eludan los sistemas de auditoría interna de los bancos y de sus auditores independientes. En 2000 comenté ante la American Bankers Association:

En los últimos años la tecnología rápidamente cambiante ha empezado a volver obsoleto gran parte del régimen de auditoría bancaria que se estableció en las décadas pasadas. Los reguladores bancarios están siendo forzosamente presionados a depender cada vez más de la mayor y más sofisticada disciplina del mercado privado, aún la forma más efectiva de regulación. De hecho, estos desarrollos refuerzan la verdad de una lección clave de nuestra historia bancaria: que la supervisión privada del riesgo de contraparte sigue siendo la primera línea de defensa en la regulación del sistema48.

Lamentablemente, esa primera línea de defensa fracasó.

Hace un siglo, los examinadores podían evaluar los préstamos individuales y juzgar su solidez49. Pero en el actual entorno global del crédito, ¿cómo juzga un examinador de un banco estadounidense la calidad de un préstamo a un banco ruso, por ejemplo, y por tanto la cartera de préstamos de ese banco? Lo que a su vez exigiría examinar a las contrapartes del banco ruso y las contrapartes de esas contrapartes para juzgar la solidez de una sola transacción financiera. En suma, un examinador bancario no puede y tampoco lo puede hacer una agencia calificadora de crédito. ¿Qué profundidad en el examen de los miles de capas es suficiente para la certificación?

En su operación, la complejidad de nuestro sistema financiero engendra en una semana muchas supuestas crisis que nunca suceden en ese momento, e innumerables alegatos de mal comportamiento financiero. Para examinar cada una de esas posibilidades con el nivel de detalle necesario para llegar a conclusiones precisas se necesitaría un cuerpo de examinadores muchos múltiplos mayor que el que hoy opera en cualquiera de nuestras agencias de regulación bancaria. Se puede argumentar que ese nivel de examen impediría los préstamos bancarios y la toma de los riesgos necesarios.

Por ello se exigía y aún se exige que la Reserva Federal y otros reguladores adivinen cuáles señalamientos de problemas pendientes o alegatos de mal comportamiento deben ser sometidos al pleno escrutinio de un cuerpo de funcionarios que necesariamente tiene limitada capacidad de examen. Pero este dilema significa que después de la siguiente crisis veremos que examinadores muy competentes no pudieron detectar a un Madoff. La supervisión y la evaluación de la Reserva Federal son tan buenas como es posible, aun considerando las fallas de los años anteriores. Pero los bancos tienen pocas opciones, salvo la de confiar en su vigilancia del riesgo de contraparte como primera línea de defensa de las crisis50.

EL PAPEL DE LA POLÍTICA MONETARIA

LA POLÍTICA MONETARIA Y LAS BURBUJAS DE PRECIOS DE LA VIVIENDA

La burbuja global de los precios de la vivienda fue una consecuencia de las bajas tasas de interés, pero fueron las tasas de interés de largo plazo las que impulsaron los precios de los activos de vivienda, no las tasas de interés de intervención de los bancos centrales, como ha llegado a ser la sabiduría convencional. En Estados Unidos, la burbuja de precios de la vivienda fue inducida por el bajo nivel de la tasa fija de las hipotecas a 30 años, que empezó a descender de su pico de mediados de la década de 2000 seis meses antes de que la Reserva Federal redujera la tasa de fondos federales en enero de 2001.

Entre 2002 y 2005, las tasas mensuales de las hipotecas de vivienda a 30 años se adelantaron al cambio de los precios mensuales de la vivienda (medidos por el índice de precios de la vivienda Case Shiller en 20 ciudades) durante 11 meses, con un R2 (ajustado) de 0,511 y un estadístico t de -6,93; un indicador de precios de la vivienda mucho mejor que las tasas de fondos federales, que registraron un R2 (ajustado) de 0,216 y un estadístico t de 3,62 (con un adelanto de sólo ocho meses)51. La regresión de las tasas hipotecarias (con un adelanto de 11 meses) y la tasa de fondos federales (con un adelanto de 8 meses) contra los precios de la vivienda arroja un estadístico t altamente significativo para las hipotecas, de 5,20, pero un estadístico t no significativo para la tasa de fondos federales, de -0,51.

Esto no debería sorprender. Después de todo, los precios de los activos de larga duración siempre se han determinado descontando el flujo de ingresos (o los servicios imputados) por las tasas de interés de igual vencimiento que la vida del activo. Nadie, que yo sepa, utiliza las tasas de interés interbancarias –como las tasas de los fondos federales– para determinar la tasa de capitalización de los bienes raíces, bien sean los flujos de efectivo de un edificio de oficinas o el arriendo imputado de una residencia unifamiliar.

Es comprensible por qué antes de 2002 se percibía que las tasas de fondos federales eran un indicador anticipado de muchas series estadísticas que en realidad tienen una relación causal con tasas de interés de más largo plazo. En Estados Unidos, el coeficiente de correlación entre las tasas de fondos federales y la tasa de hipotecas a 30 años desde 1963 hasta 2002, por ejemplo, fue de un estrecho 0,8352. En consecuencia, durante esos años, las regresiones en las que los precios de la vivienda eran la variable dependiente funcionaban igualmente bien con tasas de largo plazo o con tasas de interés interbancario como variable explicativa.

Pero la tasa de las hipotecas a 30 años se desvinculó claramente de la tasa de los fondos federales en la primera parte de esta década. La correlación entre la tasa de los fondos y la tasa hipotecaria a 30 años cayó a un insignificante 0,17 entre 2002 y 2005, el período en que la burbuja fue más intensa, y como consecuencia la tasa de los fondos tuvo poca influencia en los precios de la vivienda, si es que tuvo alguna.

La tasa de los fondos federales se redujo del 6½% de comienzos de 2001 al 1¾% a finales de 2001, y luego al 1% a mediados de 2003, una tasa que se mantuvo durante un año. La Reserva Federal vio la tasa del 1% como una medida preventiva frente a la tasa decreciente de inflación en 2003, que tenía características similares a la deflación japonesa de la década de 1990. La Reserva Federal pensaba que la probabilidad de deflación era pequeña pero que, si ocurría, los efectos serían peligrosos. Aunque reconoció que una tasa de fondos demasiado baja durante mucho tiempo podía alentar la inflación de precios de los productos. En esa época pensé que la reducción de la tasa reflejaba, no obstante, un balance apropiado de los riesgos. Aún lo pienso.

Que yo sepa, esa reducción de la tasa de los fondos federales hace casi una década no se consideró un factor clave de la burbuja de la vivienda. De hecho, tan tarde como en enero de 2006, Milton Friedman, el crítico más severo de la Reserva Federal, en su evaluación del período 1987-2005 escribió: no hay ningún otro período de duración comparable en el que el Sistema de la Reserva Federal haya tenido tan buen desempeño. Es más que una diferencia cuantitativa, se acerca a una diferencia cualitativa53.

Resulta entonces sorprendente que, en agosto de 2007, John Taylor, de la Universidad de Stanford (con quien raras veces disiento), argumentara que la política de la Reserva Federal luego de la burbuja de las empresas puntocom fue la causa principal del surgimiento de la burbuja de la vivienda en Estados Unidos (Taylor, 2007).

Según él, si la tasa de los fondos federales hubiera seguido su regla epónima, el número de viviendas iniciadas habría sido mucho más bajo y la economía de Estados Unidos habría evitado gran parte del boom de la vivienda y de la burbuja de precios. Temo que su conclusión, copiada y repetida con frecuencia, parece haber llegado muy cerca de ser la sabiduría convencional54.

Como evidencia, Taylor señala primero la correlación inversa significativa, con un rezago, de mediados de 1959 a mediados de 2007, entre la tasa de fondos federales y el número de viviendas iniciadas, y argumenta que de acuerdo con su regla (una primera aproximación útil para la posición de política monetaria de un banco central) la Reserva Federal fijó una tasa de fondos inadecuadamente baja entre 2002 y 200555. En consecuencia, el número de viviendas iniciadas llegó a un máximo de 25 años [...] El rápido ascenso de la demanda de vivienda llevó a un alza de la inflación de precios de la vivienda. El salto de la inflación de precios de la vivienda luego aceleró la demanda de vivienda en una espiral ascendente (itálicas añadidas).

Taylor equipara inapropiadamente el número de viviendas iniciadas (un incremento de la oferta) a la demanda, el principal impulsor de los precios de la vivienda. La evidencia sugiere que no es el número de viviendas iniciadas el que impulsa los precios e inicia la espiral ascendente, sino al contrario (gráfica 15). El cambio en los precios de la vivienda, con un adelanto de 6 meses, tiene un poder explicativo significativo para el número de viviendas unifamiliares iniciadas de 1976 a 2009 (R2 ajustado de 0,36 y estadístico t de 15,0). Según mi experiencia, en Estados Unidos los constructores de vivienda responden al cambio de precios para determinar cuántas viviendas para la venta empiezan a construir, y no a la tasa de fondos federales. Y el cambio de precios de la vivienda, como señalé antes, es una función de las tasas hipotecarias de largo plazo rezagadas.

El número de viviendas iniciadas, en todo caso, debería ser ajeno a la explicación de la burbuja que da Taylor. Se utiliza debido a que la Regla de Taylor está estructurada para indicar la tasa de fondos federales adecuada para balancear el trade-off entre inflación y desempleo. La Regla de Taylor no tiene como insumos los precios de los activos, particularmente los precios de la vivienda. Los precios de la vivienda no se pueden sustituir, a las buenas o a las malas, por el IPC o por el PCE en el paradigma Taylor. El IPC podría ser un proxy de los precios de la vivienda si la correlación entre precios de la vivienda e IPC fuera muy alta. Pero no lo es. La correlación entre precios de la vivienda y precios al consumidor, y entre precios de los activos en general y precios de los productos, es pequeña o insignificante o a veces negativa.

Es claro que la Regla de Taylor no se puede aplicar a los precios de los activos, especialmente cuando una inflación de precios de los productos benigna es casi con seguridad una condición necesaria para una burbuja de precios de los activos que producen ingreso56.

La interpretación correcta de una Regla de Taylor como la que se aplicó en el período de 2002 a 2005, que estipuló que la tasa de fondos federales es demasiado baja, es que la inflación de precios de los productos (el deflactor implícito del PCE para la Reserva Federal) es amenazadora y que para hacerle frente son indicados los aumentos de la tasa. Pero la inflación no amenazó. De hecho el PCE promedió una modesta tasa de inflación de apenas un 2% durante 2002-2005. De modo que la Regla de Taylor no sólo era inadecuada para evaluar las causas de los aumentos de precios de los activos sino que también daba una señal falsa para la política de estabilizar el PCE.

Los que creen que la política de dinero fácil de la Reserva Federal es el origen de la burbuja de la vivienda señalan correctamente que una baja tasa de fondos federales (del 1% entre mediados de 2003 y mediados de 2004) redujo las tasas de interés de los créditos hipotecarios con tasa de interés variable (adjustable rate mortgages, ARM). Lo que a su vez, sostienen ellos, aumentó la demanda de viviendas financiadas con ARM y, por tanto, contribuyó en forma importante al surgimiento de la burbuja.

Pero en retrospectiva parece que la decisión de comprar vivienda precede a la decisión de cómo financiar la compra. Sospecho (pero no puedo probarlo definitivamente) que una gran mayoría de compradores de vivienda financiada con ARM, si ésta no se hubiera ofrecido durante ese período de euforia, hubiese acudido a hipotecas con tasa de interés fija a 30 años. De otro modo, ¿cómo explicar el pico de originaciones de ARM dos años antes del pico de precios de la vivienda? (gráfica 16). La demanda de mercado obviamente no necesitó financiación ARM para elevar los precios durante los dos últimos años de expansión de la burbuja.

Taylor, confrontado por la evidencia de que la burbuja de la vivienda es mundial, alude a una relación aparentemente estrecha entre el grado de desviación de la Regla de Taylor y el tamaño de las burbujas en algunos países europeos (Taylor, 2009). Pero un estudio reciente de funcionarios de la Reserva Federal, que usa una muestra más amplia de países, señala que las desviaciones de la Regla de Taylor no parecen estar correlacionadas con los cambios de precios de la vivienda. Y concluye que la relación no es estadísticamente significativa (y es débil en términos económicos) (Dokko et al., 2009).

Además, John Taylor no acepta la explicación de la reducción de las tasas reales de interés de largo plazo basada en la inversión- ahorro mundial como detonador de la burbuja global de la vivienda, que denomina plétora de ahorro. Él afirma sucintamente:

Algunos argumentan que las bajas tasas de interés de 2002-2004 fueron causadas por factores globales por fuera del control de las autoridades monetarias. De ser así, las decisiones de tasas de interés de las autoridades monetarias no fueron el principal factor causante de la burbuja. Esta explicación –atractiva a primera vista porque las tasas de interés de largo plazo se mantuvieron bajas durante algún tiempo después de que la tasa de los fondos federales de corto plazo empezó a aumentar– se centra en el ahorro global. Se argumenta que hubo un exceso de ahorro mundial –una plétora de ahorro global– que presionó hacia abajo las tasas de interés de Estados Unidos y otros países. El principal problema de esta explicación es que no hay evidencia real de una plétora de ahorro global. Al contrario, [...] la tasa de ahorro mundial –el ahorro mundial como porcentaje del PIB mundial– fue baja en el período 2002-2004, especialmente si se compara con la de las décadas de 1970 y 1980 (Taylor, 2009).

Taylor utiliza datos ex post para refutar el análisis basado en las intenciones de ahorro e inversión ex ante (ver p. 5), un argumento que muchos economistas considerarían paradójico.

¿SE PODRÍA HABER EVITADO EL COLAPSO?

¿Se podría haber evitado el colapso que devastó los mercados financieros mundiales? Lo dudo mucho dado el insuficiente capital de los intermediarios financieros (es decir, el excesivo apalancamiento) y dos décadas de prosperidad prácticamente imparable, baja inflación y bajas tasas de interés de largo plazo. Esas condiciones económicas son condiciones necesarias, y quizá suficientes, para el surgimiento de una burbuja de activos rentables. Con seguridad, los bancos centrales tienen la capacidad para quebrar el espinazo de cualquier flujo prospectivo de efectivo que apoye los precios burbujeantes de los activos, pero casi con seguridad al costo de una severa contracción del producto económico, con consecuencias indeterminadas. El aspecto negativo de ese trade-off es indefinido57.

¿Pero por qué no un apretón incremental? Que yo sepa, no hay ejemplos de una desactivación incremental exitosa de una burbuja que deje la prosperidad intacta. El apretón incremental exitoso de los bancos centrales para desactivar gradualmente una burbuja requiere retroalimentación en el corto plazo58.

Pero la política afecta a la economía con rezagos largos y variables de hasta uno o dos años59. ¿Cómo sabe la Reserva Federal, en tiempo real, si su política cada vez más contraccionista está afectando la economía al ritmo que aquella requiere? ¿Con qué adelanto tendrá que apretar para desinflar la burbuja sin desactivar la economía? Pero aún más relevante, a menos que el apretón incremental de la Reserva Federal aumente significativamente la aversión al riesgo (y las tasas de interés de largo plazo) o desactive la economía lo suficiente para frenar los flujos de dinero que soportan los precios de los activos relevantes, veo pocas perspectivas de éxito.